Код сети: Коды мобильных операторов

Коды мобильных операторов

Регион

ВсеАбакан Республика ХакасияАнадырь Чукотский АОАрхангельск Архангельская областьАстрахань Астраханская областьБарнаул Алтайский крайБелгород Белгородская областьБиробиджан Еврейская АОБлаговещенск Амурская областьБрянск Брянская областьВладивосток Приморский крайВладикавказ Республика Северная ОсетияВладимир Владимирская областьВолгоград Волгоградская областьВологда Вологодская областьВоронеж Воронежская областьГорно-Алтайск Республика АлтайГрозный Чеченская РеспубликаЕкатеринбург Свердловская областьИваново Ивановская областьИжевск Республика УдмуртияИркутск Иркутская областьЙошкар-Ола Республика Марий ЭлКазань Республика ТатарстанКалининград Калининградская областьКалуга Калужская областьКемерово Кемеровская областьКиров Кировская областьКострома Костромская областьКраснодар Краснодарский крайКрасноярск Красноярский крайКурган Курганская областьКурск Курская областьКызыл Республика ТываЛипецк Липецкая областьМагадан Магаданская областьМайкоп Республика АдыгеяМахачкала Республика ДагестанМинеральные воды Ставропольский крайМосква МоскваМурманск Мурманская областьН. Новгород Нижегородская областьНабережные Челны Республика ТатарстанНазрань Республика ИнгушетияНальчик Кабардино-Балкарская РеспубликаНарьян-Мар Ненецкий АОНовгород Великий Новгородская областьНовокузнецк Кемеровская областьНовосибирск Новосибирская область Норильск Красноярский крайНоябрьск Ямало-Ненецкий АООмск Омская областьОрел Орловская областьОренбург Оренбургская областьПенза Пензенская областьПермь Пермский крайПетрозаводск Республика КарелияПетропавловск-Камчатский Камчатский крайПсков Псковская областьРеспублика Крым Республика КрымРостов-на-Дону Ростовская областьРязань Рязанская областьСамара Самарская областьСанкт-Петербург Санкт-ПетербургСаранск Республика МордовияСаратов Саратовская областьСмоленск Смоленская областьСочи Краснодарский крайСтаврополь Ставропольский крайСургут Ханты-Мансийский АОСыктывкар Республика КомиТамбов Тамбовская областьТверь Тверская областьТольятти Самарская областьТомск Томская областьТула Тульская областьТюмень Тюменская областьУлан-Удэ Республика БурятияУльяновск Ульяновская областьУфа Республика БашкортостанХабаровск Хабаровский КрайХанты-Мансийск Ханты-Мансийский АОЧебоксары Чувашская РеспубликаЧелябинск Челябинская областьЧереповец Вологодская областьЧеркесск Карачаево-Черкесская РеспубликаЧита Забайкальский крайЭлиста Республика КалмыкияЮжно-Сахалинск Сахалинская областьЯкутск Республика Саха (Якутия)Ярославль Ярославская область

Новгород Нижегородская областьНабережные Челны Республика ТатарстанНазрань Республика ИнгушетияНальчик Кабардино-Балкарская РеспубликаНарьян-Мар Ненецкий АОНовгород Великий Новгородская областьНовокузнецк Кемеровская областьНовосибирск Новосибирская область Норильск Красноярский крайНоябрьск Ямало-Ненецкий АООмск Омская областьОрел Орловская областьОренбург Оренбургская областьПенза Пензенская областьПермь Пермский крайПетрозаводск Республика КарелияПетропавловск-Камчатский Камчатский крайПсков Псковская областьРеспублика Крым Республика КрымРостов-на-Дону Ростовская областьРязань Рязанская областьСамара Самарская областьСанкт-Петербург Санкт-ПетербургСаранск Республика МордовияСаратов Саратовская областьСмоленск Смоленская областьСочи Краснодарский крайСтаврополь Ставропольский крайСургут Ханты-Мансийский АОСыктывкар Республика КомиТамбов Тамбовская областьТверь Тверская областьТольятти Самарская областьТомск Томская областьТула Тульская областьТюмень Тюменская областьУлан-Удэ Республика БурятияУльяновск Ульяновская областьУфа Республика БашкортостанХабаровск Хабаровский КрайХанты-Мансийск Ханты-Мансийский АОЧебоксары Чувашская РеспубликаЧелябинск Челябинская областьЧереповец Вологодская областьЧеркесск Карачаево-Черкесская РеспубликаЧита Забайкальский крайЭлиста Республика КалмыкияЮжно-Сахалинск Сахалинская областьЯкутск Республика Саха (Якутия)Ярославль Ярославская область

Оператор

Все»Уралсвязьинформ» ОАО «Ростелеком»Архангельский ф-л ОАО «Ростелеком»ЗАО «АКОС»ЗАО «Адыгейская Сотовая Связь»ЗАО «Амурский Сотовый Телефон»ЗАО «Архангельские Мобильные Сети»ЗАО «Астарта» в Камчатском краеЗАО «Астрахань-GSM»ЗАО «Байкалвестком»ЗАО «Белгородская Сотовая Связь»ЗАО «Брянские Сотовые Сети»ЗАО «Вайнах Телеком»ЗАО «Волгоград-GSM»ЗАО «Вотек Мобайл»ЗАО «Дельта Телеком»ЗАО «Дельта Телеком» Филиал в Мурманской областиЗАО «Енисейтелеком»ЗАО «Кемеровская Мобильная Связь»ЗАО «Кемеровская Мобильная Связь» КрасноярскЗАО «Кемеровская Мобильная Связь» НовосибирскЗАО «Кемеровская Мобильная Связь» ТомскЗАО «Курская Сотовая Связь»ЗАО «Липецк Мобайл»ЗАО «Мурманская Мобильная Сеть»ЗАО «Нижегородская Сотовая Связь»ЗАО «Новгородские Телекоммуникации»ЗАО «Оренбург GSM»ЗАО «Парма Мобайл»ЗАО «Пенза-GSM»ЗАО «Ростовская Сотовая Связь»ЗАО «Саратовская Система Сотовой Связи»ЗАО «Сахалин Телеком Мобайл»ЗАО «Сибинтертелеком»ЗАО «Сибирская Сотовая Связь»ЗАО «Сибирская Сотовая Связь» АнадырьЗАО «Сибирская Сотовая Связь» БиробиджанЗАО «Сибирская Сотовая Связь» МагаданЗАО «Сибирская Сотовая Связь» Петропавловск-КамчатскийЗАО «Сибирская Сотовая Связь» Южно-СахалинскЗАО «Скай Линк» филиал в Кемеровской обл. ЗАО «Смоленская Сотовая Связь»ЗАО «Смоленская Сотовая Связь» БрянскЗАО «Смоленская Сотовая Связь» КалугаЗАО «Смоленская Сотовая Связь» ТверьЗАО «Смоленские Мобильные Сети»ЗАО «Сотел Астрахань»ЗАО «Сотовая Связь Удмуртии»ЗАО «Сотовый Телефон Кузбасса Джи Эс Эм»ЗАО «Тульская Сотовая Радиотелефонная Связь»ЗАО «Уралвестком»ЗАО «Череповецкая Сотовая Связь»_ЗАКРЫТЗАО «Шупашкар-GSM»ЗАО «Ярославль-GSM»Ивановский ф-л ОАО «Ростелеком»Камчатский ф-л ОАО «Ростелеком»Костромской ф-л ОАО «Ростелеком»Магаданский ф-л ОАО «Ростелеком»ОАО «Алтайсвязь»ОАО «Апекс»ОАО «Арктик Регион Связь»ОАО «Вымпел-Коммуникации»ОАО «Калининградские Мобильные Сети»ОАО «Мегафон» 3G_Дальневосточный филиалОАО «Мегафон» 3G_Кавказский филиалОАО «Мегафон» 3G_Поволжский филиалОАО «Мегафон» 3G_Сибирский филиалОАО «Мегафон» 3G_Уральский филиалОАО «Мегафон» 3G_Центральный филиалОАО «Мегафон» Дальневосточный филиалОАО «Мегафон» Кавказский филиалОАО «Мегафон» Поволжский филиалОАО «Мегафон» Северо-Западный филиалОАО «Мегафон» Сибирский филиалОАО «Мегафон» Столичный филиалОАО «Мегафон» Уральский филиалОАО «Мегафон» Центральный филиалОАО «Мобильные ТелеСистемы»ОАО «Мобильные Телесистемы»ОАО «Московская Сотовая Связь»ОАО «Региональный Технический Центр»ОАО «СМАРТС»ОАО «Санкт-Петербург Телеком»ОАО «Санкт-Петербург Телеком» ВологдаОАО «Санкт-Петербург Телеком» Нарьян-МарОАО «Санкт-Петербург Телеком» ПетрозаводскОАО «Санкт-Петербург Телеком» ПсковОАО «Северо-Восточные Телекоммуникации»ОАО «Сотовая Связь Башкортостана»ОАО «Центральный Телеграф»ООО «Беспроводные информационные технологии»ООО «Глобал Телеком»ООО «Екатеринбург-2000″ООО «К-Телеком»ООО «Матрикс Телеком»ООО «Персональные Системы Связи в Регионе»ООО «Скартел»ООО «Телеком Евразия»ООО «Телесет ЛТД»ООО «Челябинская Сотовая связь»Республика Марий Эл ф-л ОАО «Ростелеком»Самарский ф-л ОАО «Ростелеком»Тамбовский ф-л ОАО «Ростелеком»Томский ф-л ОАО «Ростелеком»Филиал ЗАО «Астарта» в Алтайском краеФилиал ЗАО «Астарта» в Волгоградской областиФилиал ЗАО «Астарта» в Воронежской областиФилиал ЗАО «Астарта» в Калужской областиФилиал ЗАО «Астарта» в Кировской областиФилиал ЗАО «Астарта» в Краснодарском краеФилиал ЗАО «Астарта» в Нижегородской областиФилиал ЗАО «Астарта» в Новосибирской областиФилиал ЗАО «Астарта» в Омской областиФилиал ЗАО «Астарта» в Ростовской областиФилиал ЗАО «Астарта» в Рязанской областиФилиал ЗАО «Астарта» в Тверской областиФилиал ЗАО «Астарта» в Удмуртской республикеФилиал ЗАО «Астарта» в Ульяновской областиФилиал ЗАО «Астарта» в Хабаровском краеФилиал ЗАО «Астарта» в республике Северная ОсетияФилиал ЗАО «Астарта» во Владимирской областиХакасский ф-л ОАО «Ростелеком»Ярославский ф-л ОАО «Ростелеком»

ЗАО «Смоленская Сотовая Связь»ЗАО «Смоленская Сотовая Связь» БрянскЗАО «Смоленская Сотовая Связь» КалугаЗАО «Смоленская Сотовая Связь» ТверьЗАО «Смоленские Мобильные Сети»ЗАО «Сотел Астрахань»ЗАО «Сотовая Связь Удмуртии»ЗАО «Сотовый Телефон Кузбасса Джи Эс Эм»ЗАО «Тульская Сотовая Радиотелефонная Связь»ЗАО «Уралвестком»ЗАО «Череповецкая Сотовая Связь»_ЗАКРЫТЗАО «Шупашкар-GSM»ЗАО «Ярославль-GSM»Ивановский ф-л ОАО «Ростелеком»Камчатский ф-л ОАО «Ростелеком»Костромской ф-л ОАО «Ростелеком»Магаданский ф-л ОАО «Ростелеком»ОАО «Алтайсвязь»ОАО «Апекс»ОАО «Арктик Регион Связь»ОАО «Вымпел-Коммуникации»ОАО «Калининградские Мобильные Сети»ОАО «Мегафон» 3G_Дальневосточный филиалОАО «Мегафон» 3G_Кавказский филиалОАО «Мегафон» 3G_Поволжский филиалОАО «Мегафон» 3G_Сибирский филиалОАО «Мегафон» 3G_Уральский филиалОАО «Мегафон» 3G_Центральный филиалОАО «Мегафон» Дальневосточный филиалОАО «Мегафон» Кавказский филиалОАО «Мегафон» Поволжский филиалОАО «Мегафон» Северо-Западный филиалОАО «Мегафон» Сибирский филиалОАО «Мегафон» Столичный филиалОАО «Мегафон» Уральский филиалОАО «Мегафон» Центральный филиалОАО «Мобильные ТелеСистемы»ОАО «Мобильные Телесистемы»ОАО «Московская Сотовая Связь»ОАО «Региональный Технический Центр»ОАО «СМАРТС»ОАО «Санкт-Петербург Телеком»ОАО «Санкт-Петербург Телеком» ВологдаОАО «Санкт-Петербург Телеком» Нарьян-МарОАО «Санкт-Петербург Телеком» ПетрозаводскОАО «Санкт-Петербург Телеком» ПсковОАО «Северо-Восточные Телекоммуникации»ОАО «Сотовая Связь Башкортостана»ОАО «Центральный Телеграф»ООО «Беспроводные информационные технологии»ООО «Глобал Телеком»ООО «Екатеринбург-2000″ООО «К-Телеком»ООО «Матрикс Телеком»ООО «Персональные Системы Связи в Регионе»ООО «Скартел»ООО «Телеком Евразия»ООО «Телесет ЛТД»ООО «Челябинская Сотовая связь»Республика Марий Эл ф-л ОАО «Ростелеком»Самарский ф-л ОАО «Ростелеком»Тамбовский ф-л ОАО «Ростелеком»Томский ф-л ОАО «Ростелеком»Филиал ЗАО «Астарта» в Алтайском краеФилиал ЗАО «Астарта» в Волгоградской областиФилиал ЗАО «Астарта» в Воронежской областиФилиал ЗАО «Астарта» в Калужской областиФилиал ЗАО «Астарта» в Кировской областиФилиал ЗАО «Астарта» в Краснодарском краеФилиал ЗАО «Астарта» в Нижегородской областиФилиал ЗАО «Астарта» в Новосибирской областиФилиал ЗАО «Астарта» в Омской областиФилиал ЗАО «Астарта» в Ростовской областиФилиал ЗАО «Астарта» в Рязанской областиФилиал ЗАО «Астарта» в Тверской областиФилиал ЗАО «Астарта» в Удмуртской республикеФилиал ЗАО «Астарта» в Ульяновской областиФилиал ЗАО «Астарта» в Хабаровском краеФилиал ЗАО «Астарта» в республике Северная ОсетияФилиал ЗАО «Астарта» во Владимирской областиХакасский ф-л ОАО «Ростелеком»Ярославский ф-л ОАО «Ростелеком»

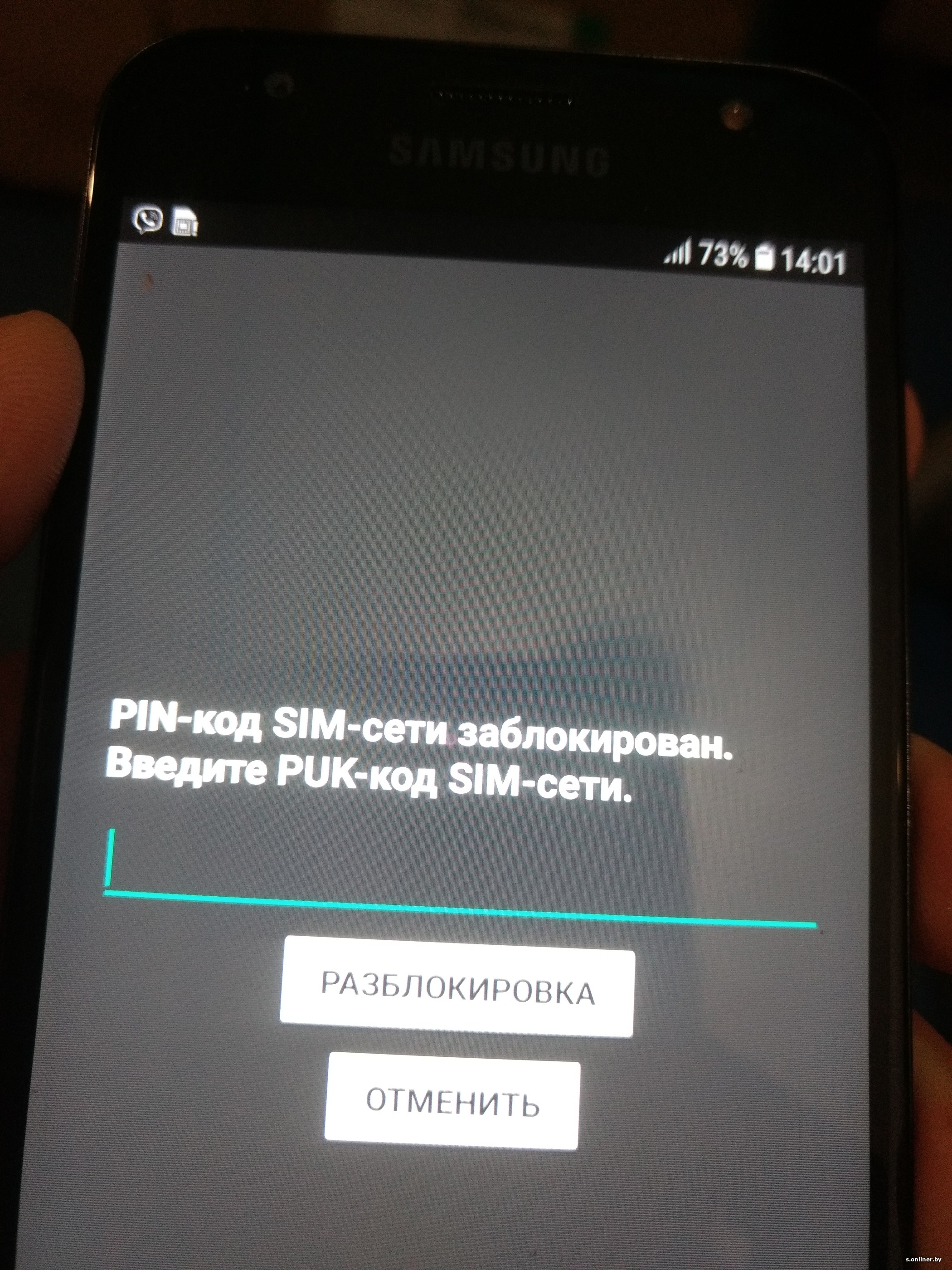

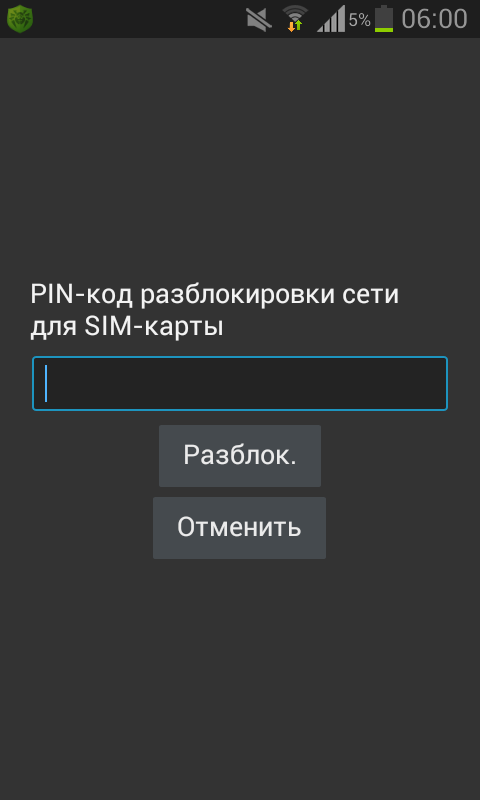

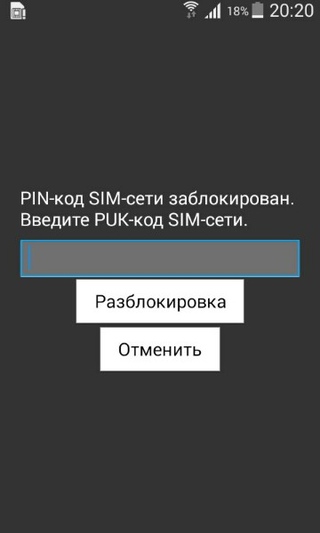

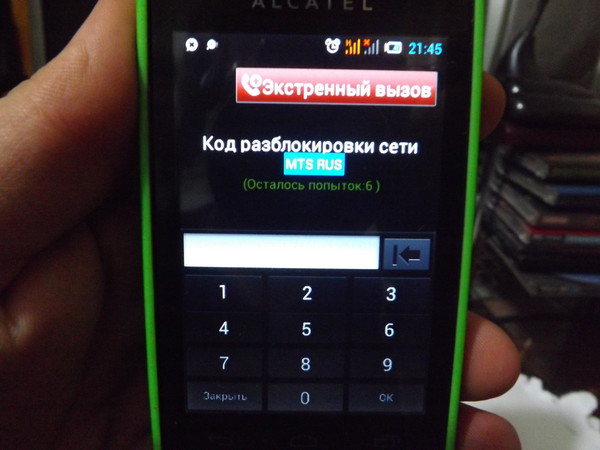

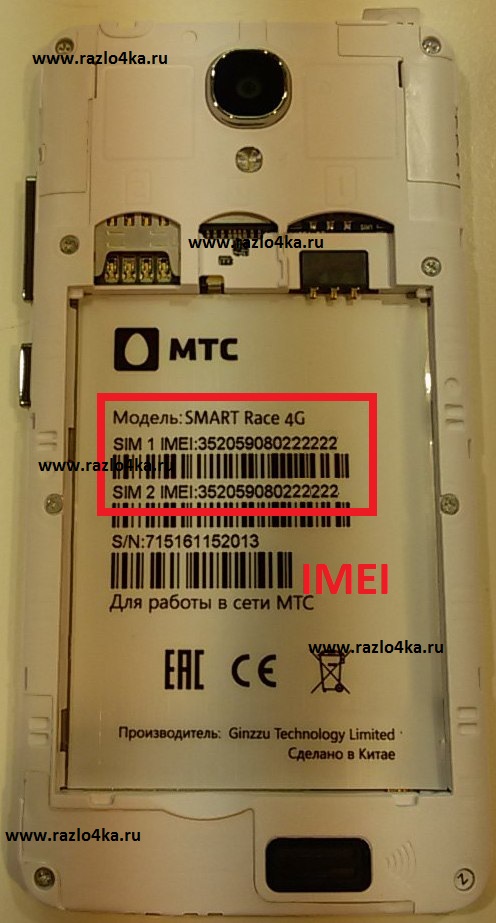

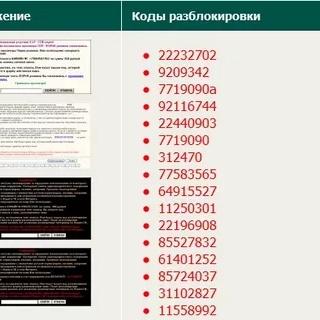

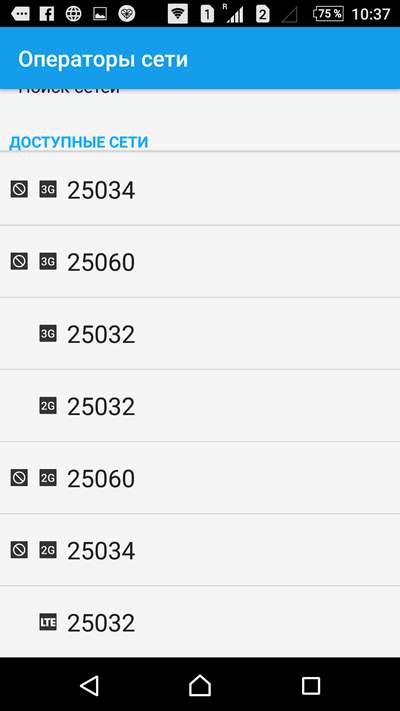

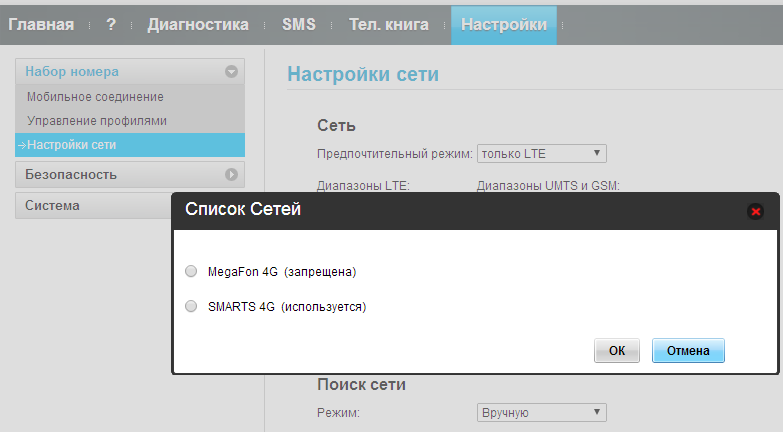

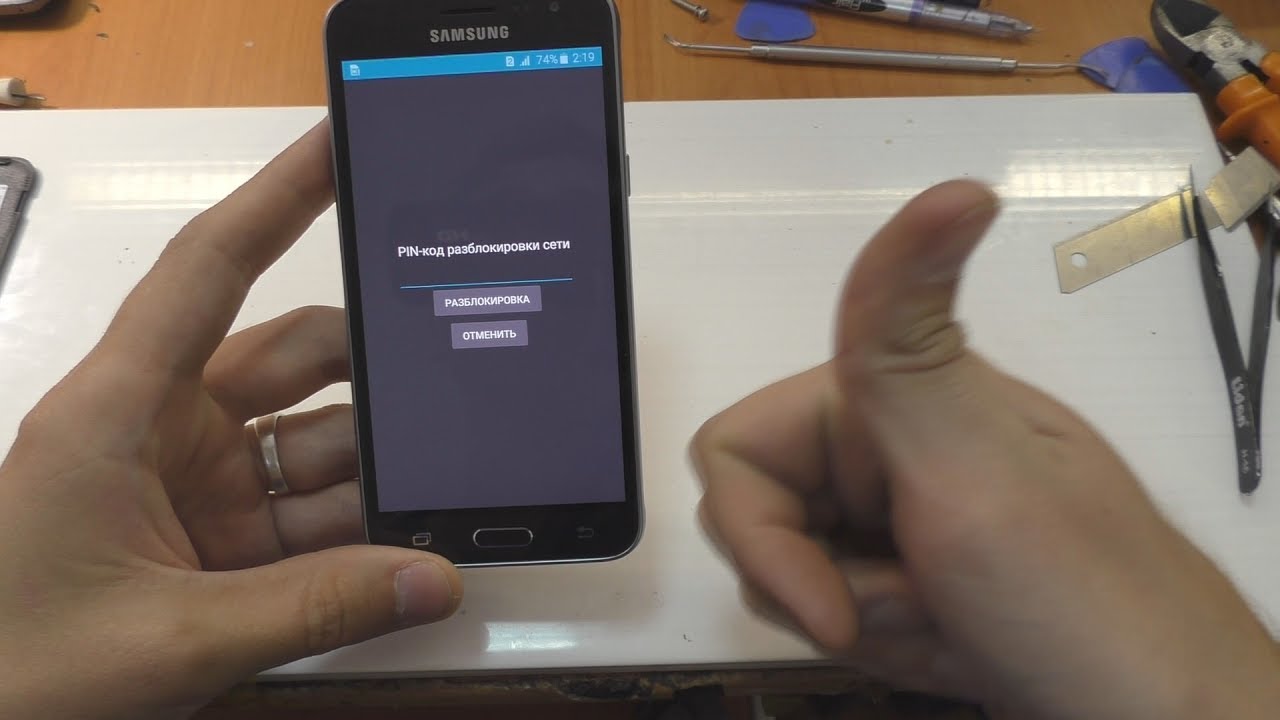

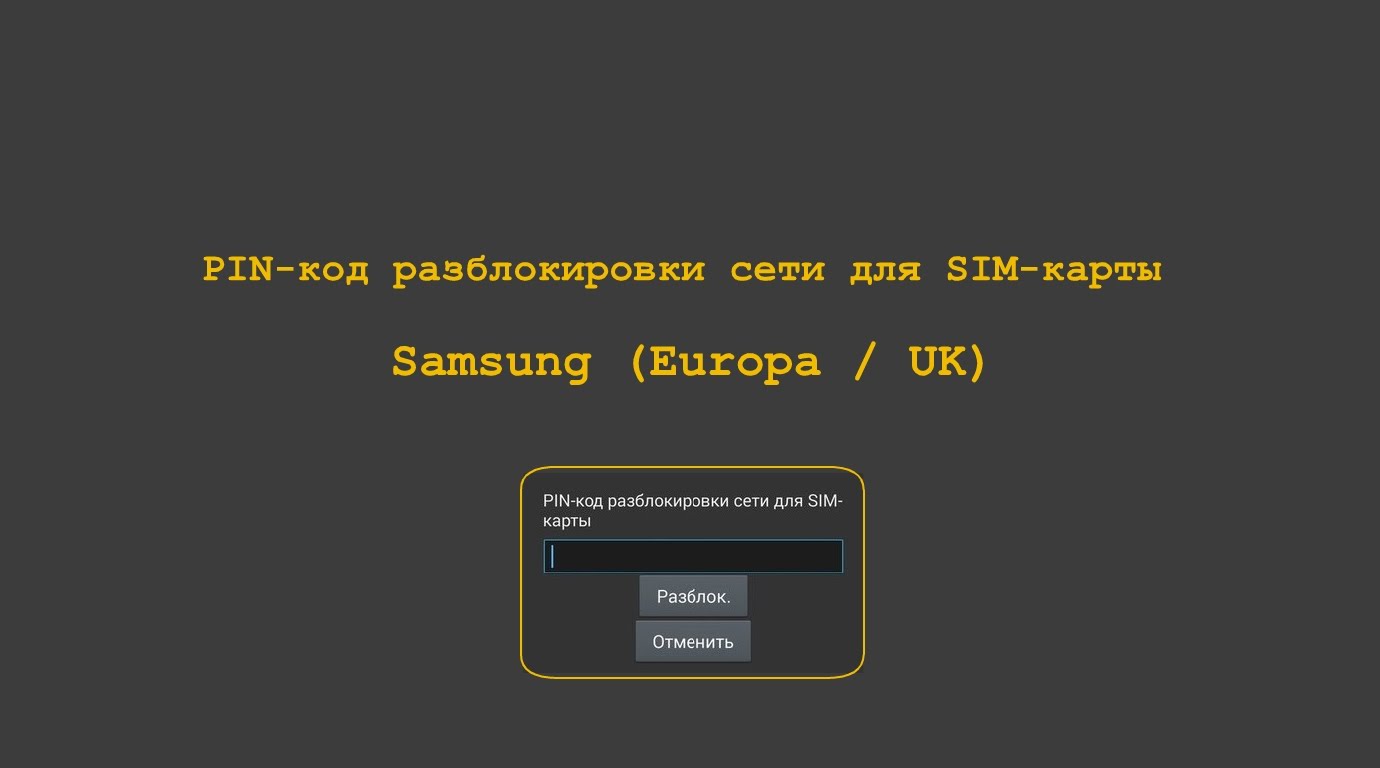

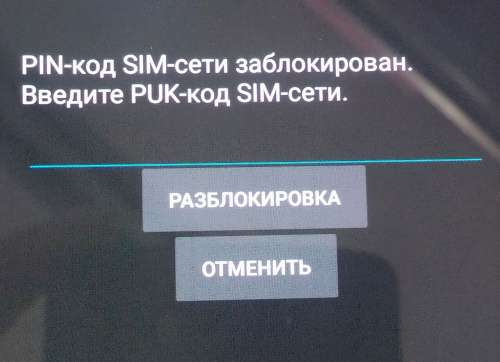

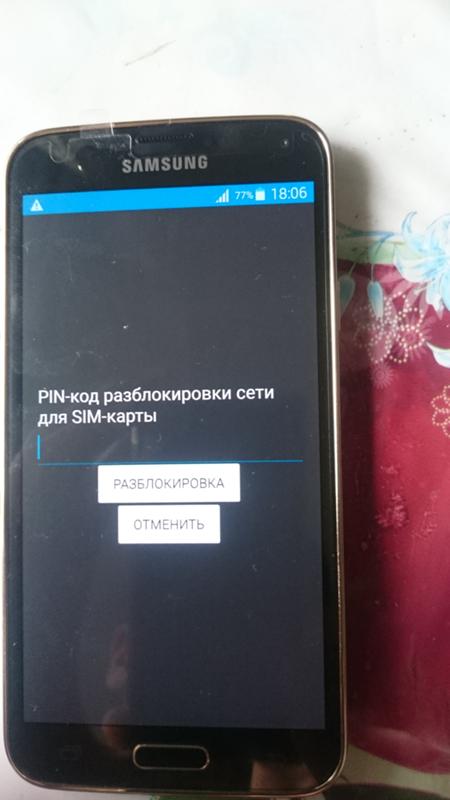

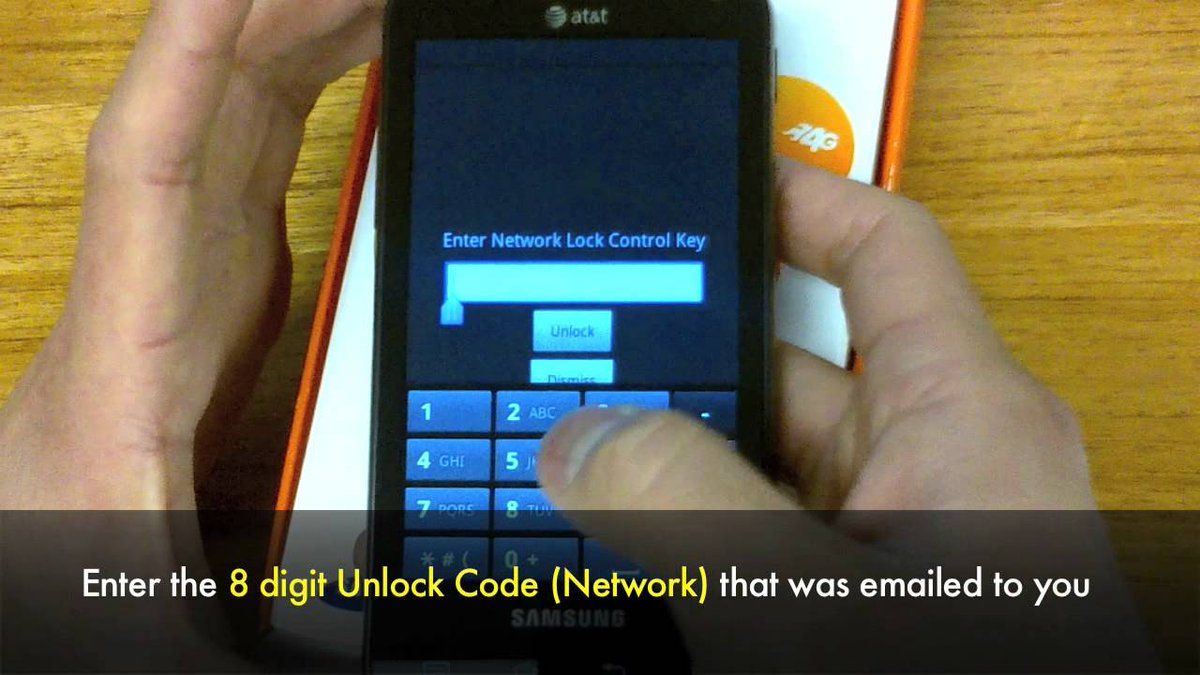

введите коды Samsung для разблокировки сети

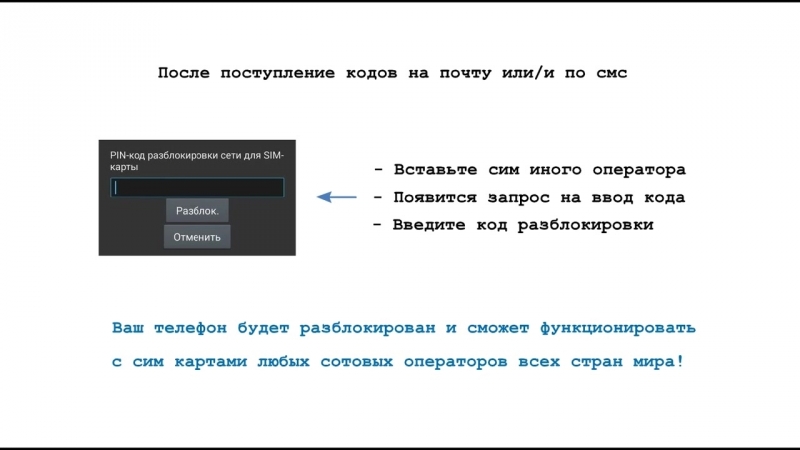

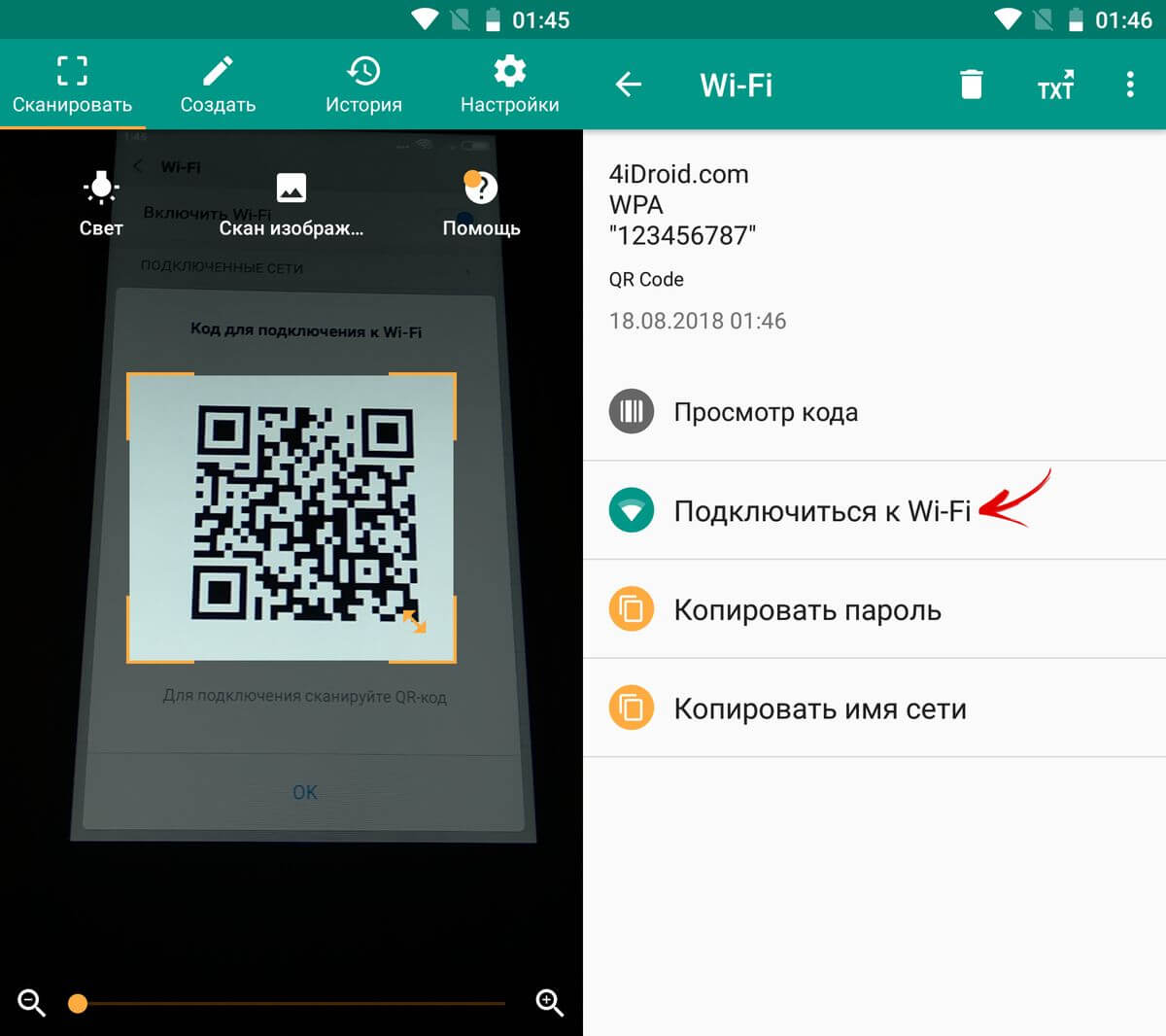

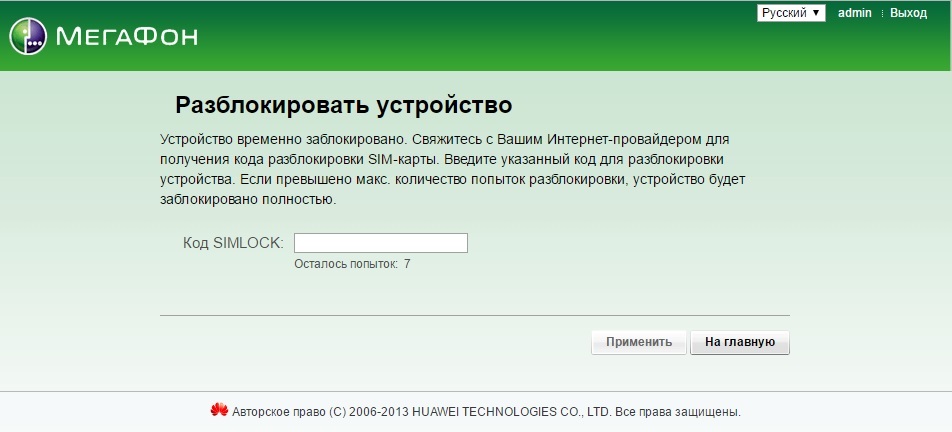

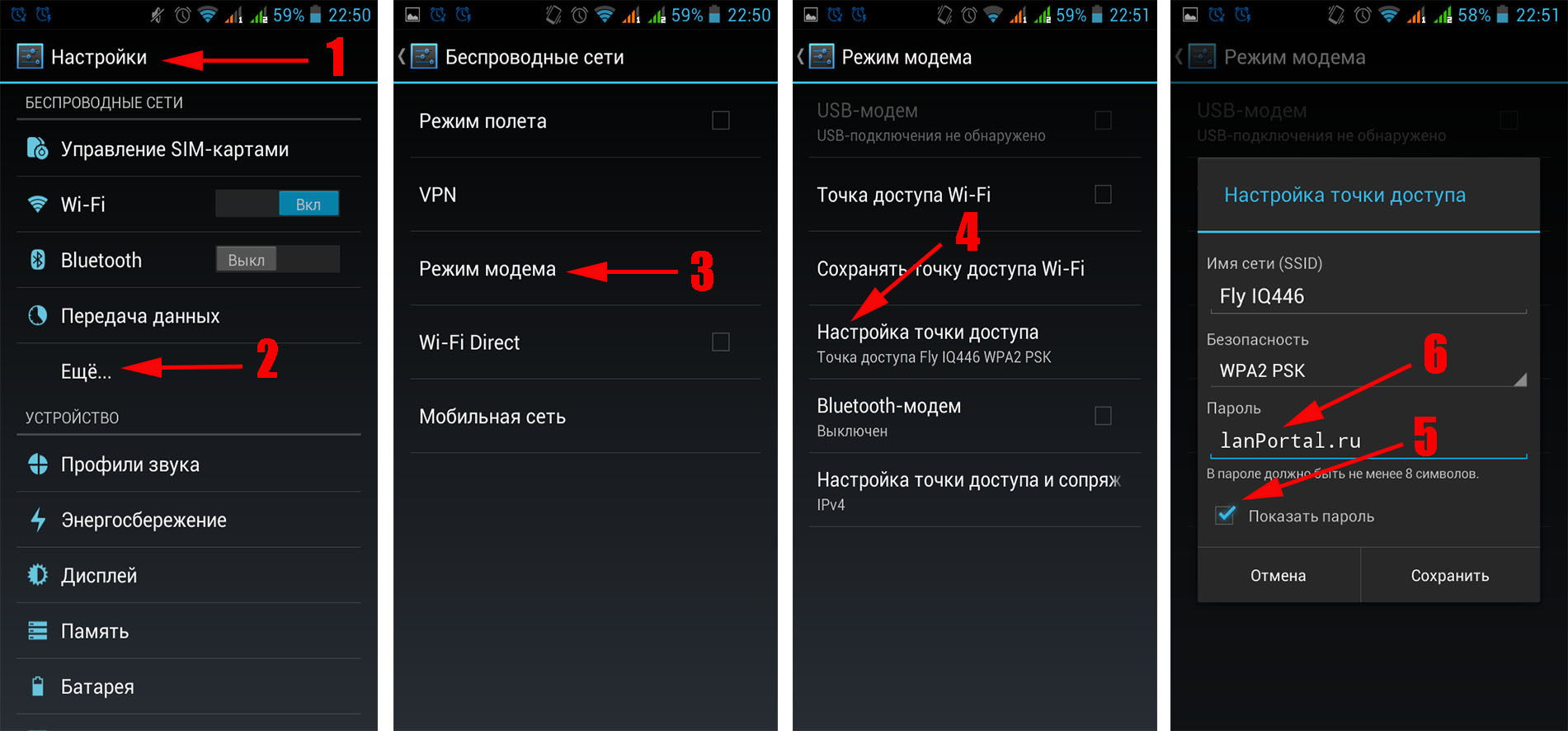

Перед тем, как вы углубитесь в статью, вы должны знать, что это учебное руководство, предназначенное для того, чтобы помочь вам исправить ваше устройство Samsung, введя секретные коды. Эти коды разблокировки могут быть использованы для разблокировки SIM-карты. Если вы можете сделать это, то вы сможете использовать SIM-карты разных операторов на вашем устройстве. Статья заполнена несколькими инструкциями о том, как использовать код разблокировки Samsung; Инструкции будут различаться в зависимости от модели устройства. Поэтому было бы лучше, если бы вы очень тщательно следовали инструкциям, поскольку простая ошибка может повредить ваше новое устройство или навсегда изменить конфигурацию.

Эти коды разблокировки могут быть использованы для разблокировки SIM-карты. Если вы можете сделать это, то вы сможете использовать SIM-карты разных операторов на вашем устройстве. Статья заполнена несколькими инструкциями о том, как использовать код разблокировки Samsung; Инструкции будут различаться в зависимости от модели устройства. Поэтому было бы лучше, если бы вы очень тщательно следовали инструкциям, поскольку простая ошибка может повредить ваше новое устройство или навсегда изменить конфигурацию.

Действия по вводу кода разблокировки Samsung

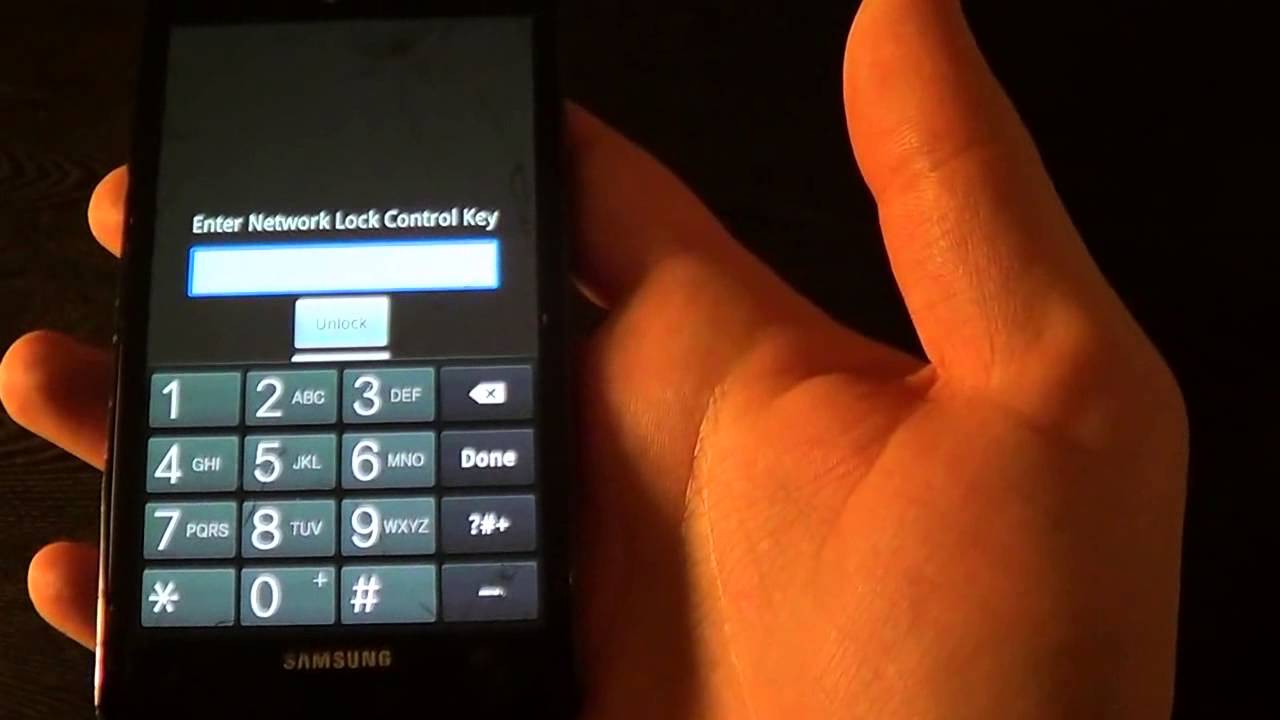

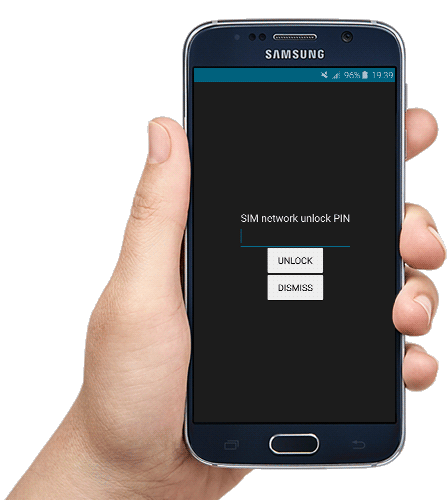

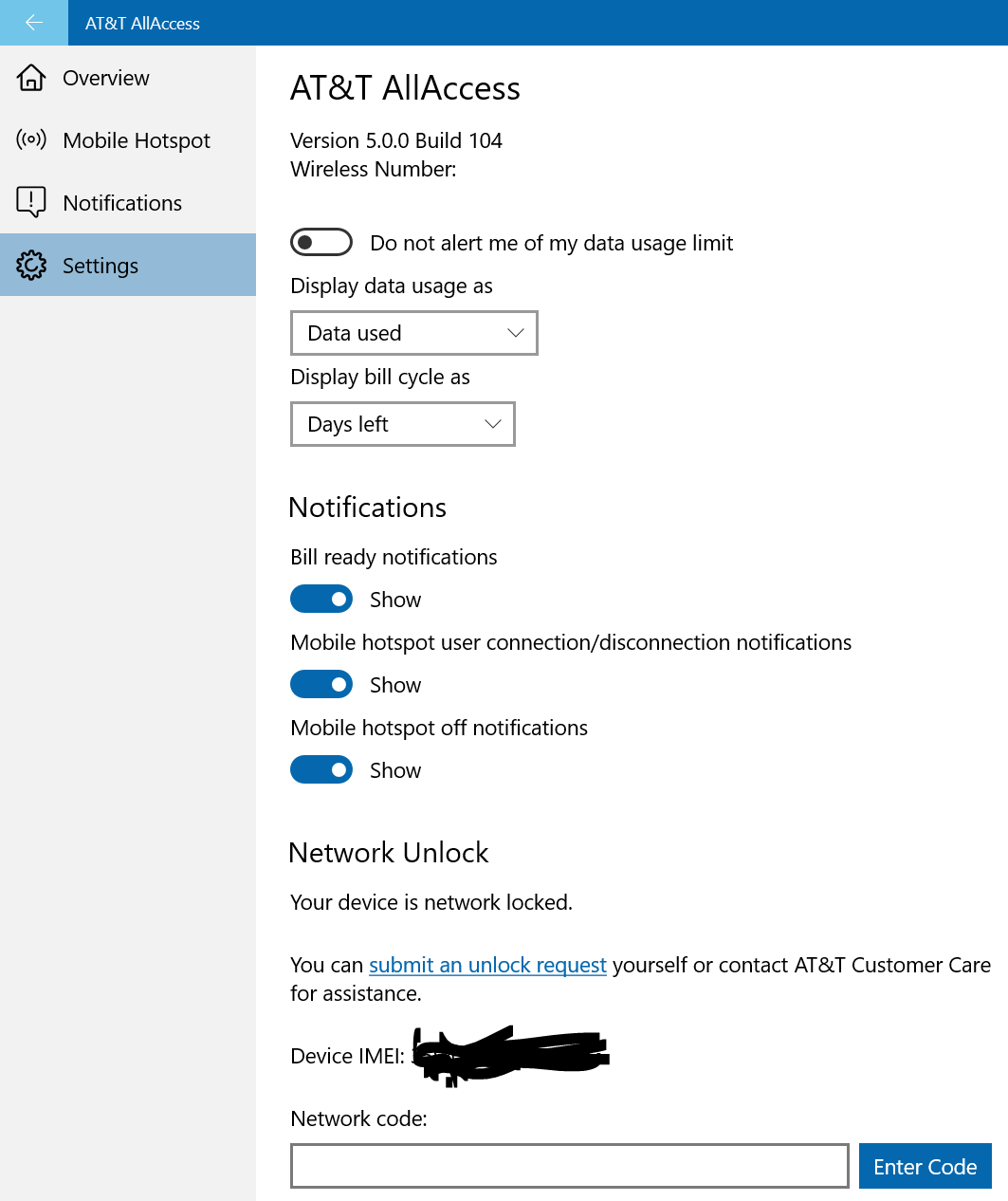

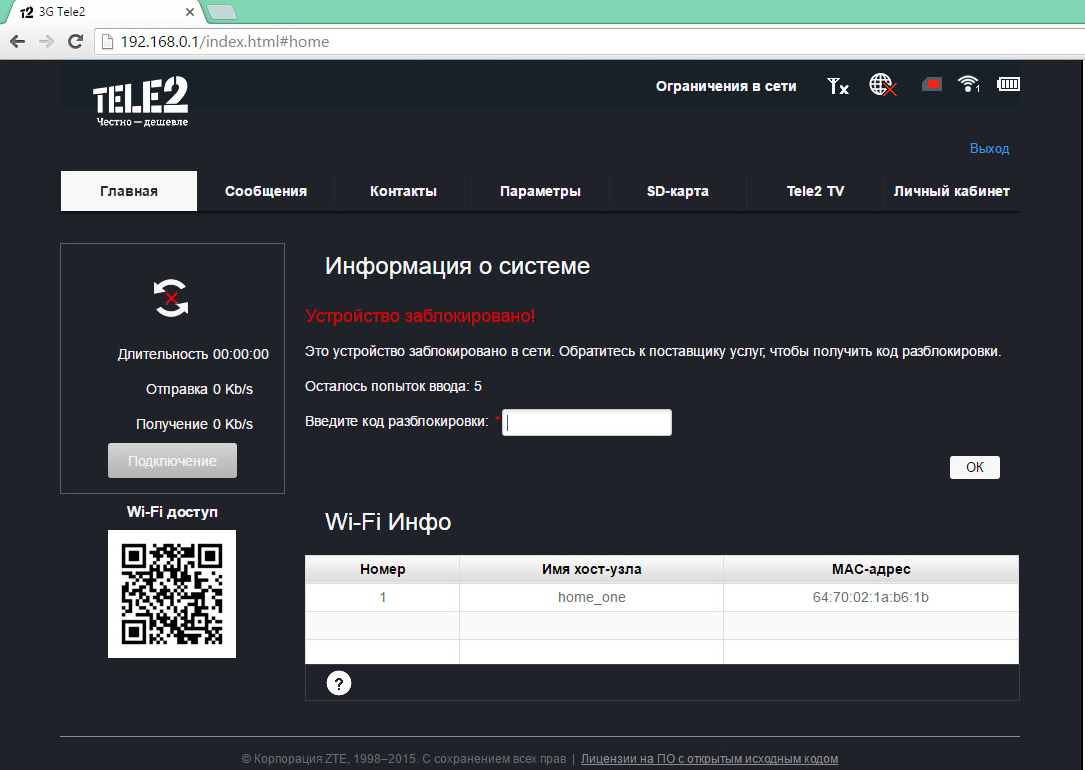

Эти шаги помогут вам получить доступ к блокировке сети, после чего вы перейдете на экран «Ключ управления блокировкой сети». Затем вам потребуется код разблокировки сети Samsung, чтобы освободить SIM-карту.

Вот несколько общих советов и процедур, которые можно использовать для разблокировки устройства Samsung;

Советы: (Это работает на большинстве телефонов Samsung)

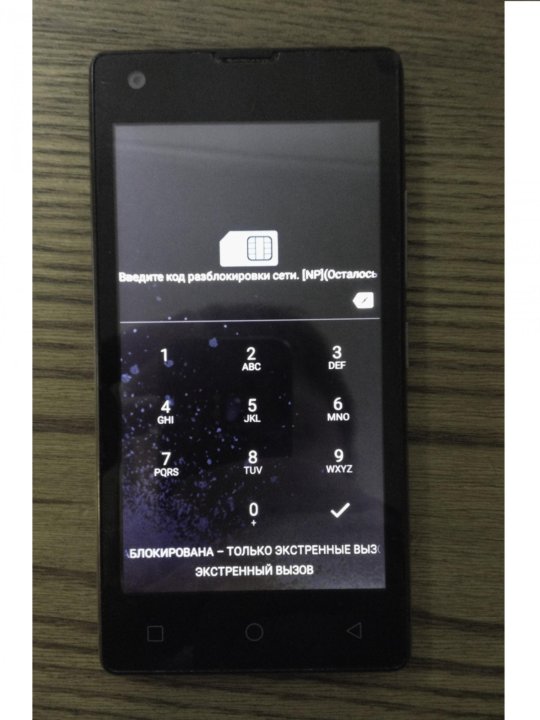

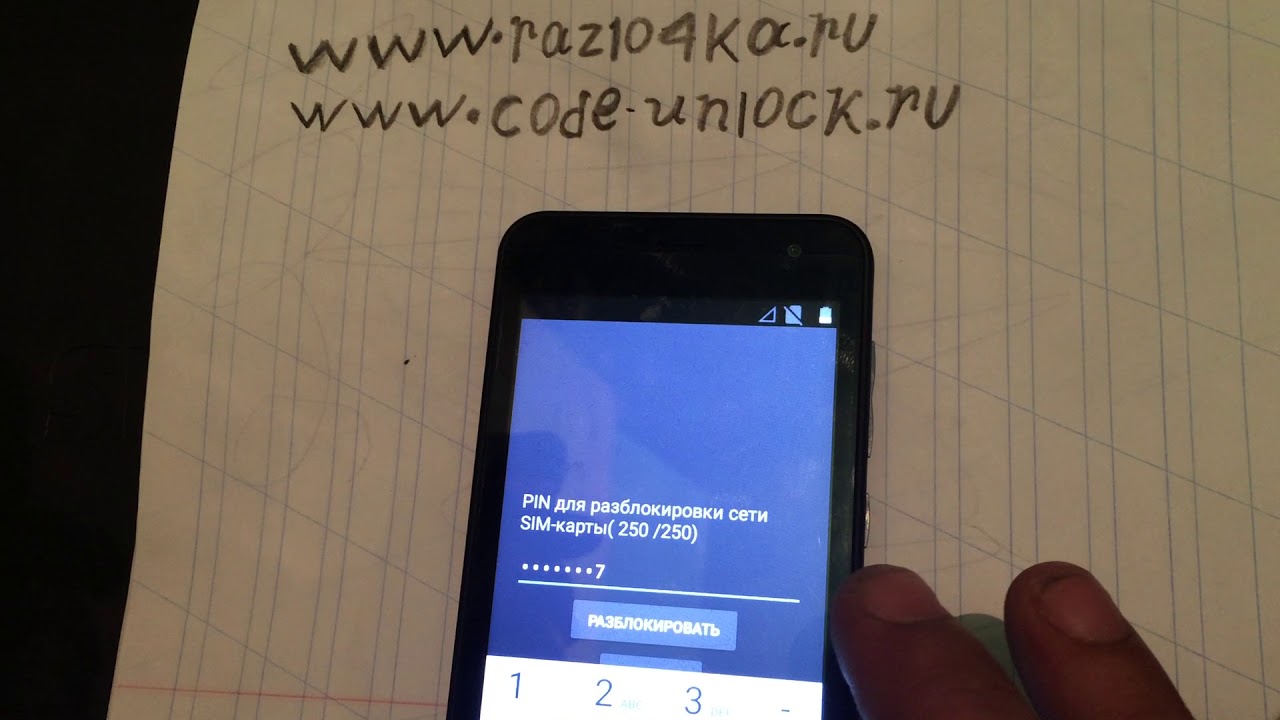

- Шаг 1. Сначала необходимо выключить устройство, а затем вставить SIM-карту другого оператора.

- Шаг 2. Затем снова включите устройство, и вам будет предложено ввести код разблокировки.

- Шаг 3. Введите код, и ваше устройство разблокировано.

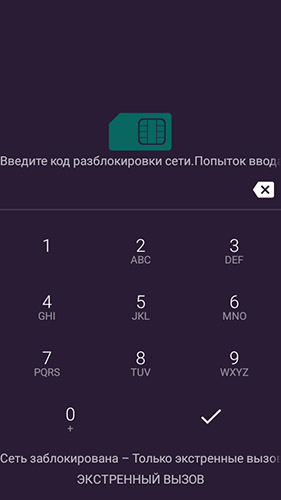

Если устройство не запрашивает коды Samsung, следуйте инструкциям ниже:

Способ 1

Способ 2

- Шаг 1. Выключите устройство Samsung, а затем вставьте SIM-карту другого оператора.

- Шаг 2. Снова включите устройство.

- Шаг 3. Теперь он запросит коды разблокировки Samsung, просто введите код UNFREEZE, но если он не запрашивает код, откройте номеронабиратель и введите UNFREEZE, а затем нажмите SEND.

- Шаг 4. Вы получите предупреждение о неудачной попытке обмена сообщениями, но не волнуйтесь, это должно произойти.

- Шаг 5. Он отключит зависание телефона, и вам будет виден экран блокировки сети.

- Шаг 6. Теперь введите коды разблокировки, и устройство будет разблокировано.

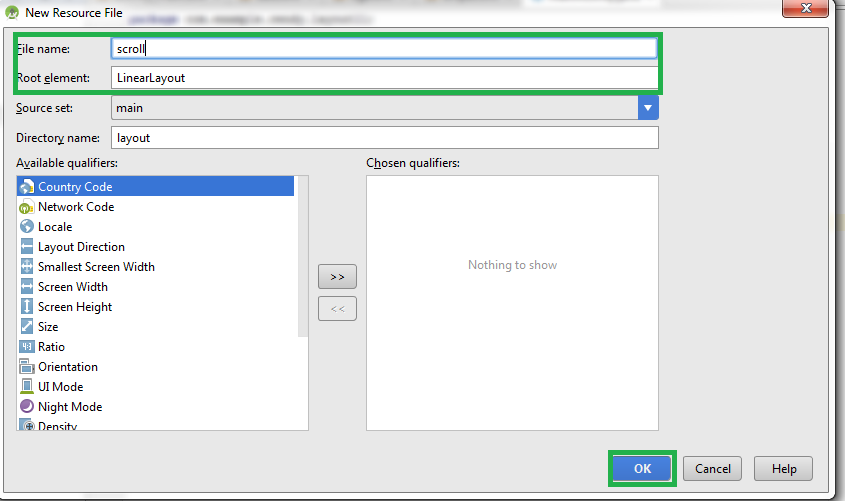

Способ 3

- Шаг 1. Вы должны попробовать этот метод без использования SIM-карты.

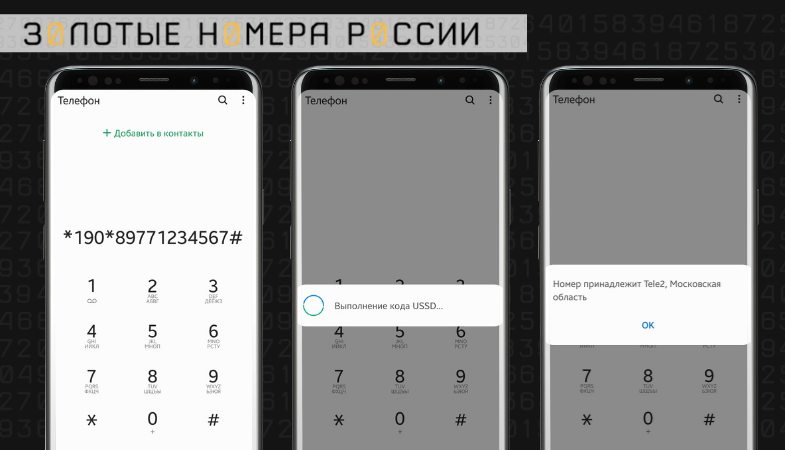

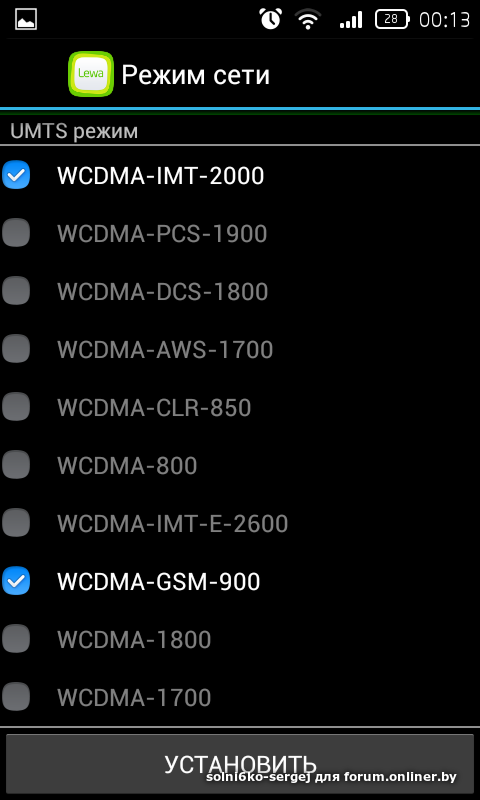

- Шаг 2. Вы должны ввести код # 7465625 * 638 * CODE #.

- Шаг 3. Этот код был фактически отправлен Samsung.

- Шаг 4. После ввода этого кода на экране появится сообщение о том, что телефон деактивирован.

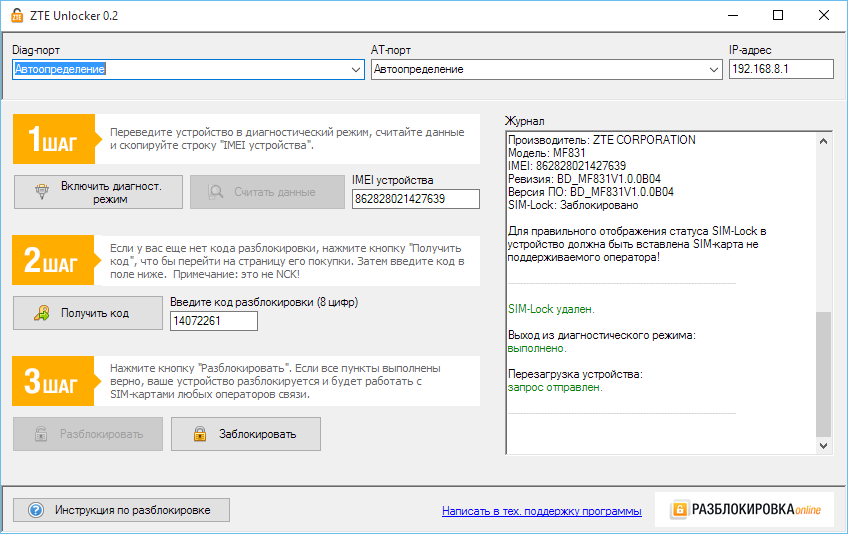

Способ 4

Для моделей Samsung: SGH-A127 / E840 / F210 / J600 / T749

- Шаг 1. Включите ваше устройство без SIM-карты.

- Шаг 2. Введите # 0111 * CODE #

- Шаг 3. Вы увидите приглашение «Блокировка сети отключена»

Устройство перезагрузится, и оно будет разблокировано.

Для Samsung SGH-A877

- Шаг 1. Включите устройство с SIM-картой.

- Шаг 2. Удерживайте устройство в портретном режиме и введите # 7465625 * 638 * CODE #

- Шаг 3. Вы увидите подсказку «Блокировка сети деактивирована», и она перезагрузится.

Для Samsung Z320i / 510 / 650i

- Шаг 1. Вставьте SIM-карту (не принимается) и включите устройство.

- Шаг 2.

введите ** CODE #

введите ** CODE #

Телефон перезагрузится автоматически.

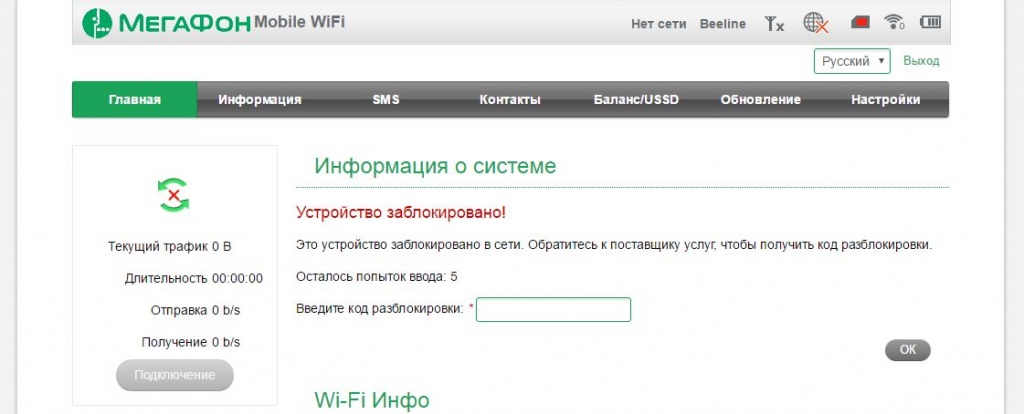

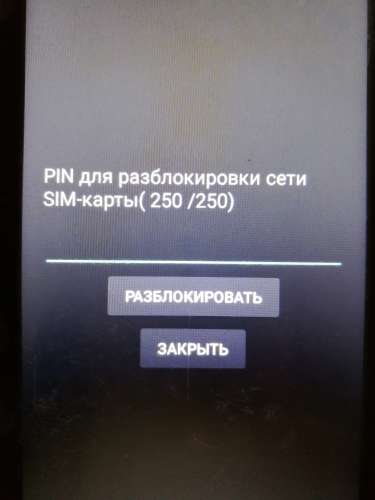

Таким образом, вы можете использовать код разблокировки своей SIM-карты на различных устройствах Samsung. Имейте в виду, что эти способы могут вызвать только экран ввода ключа управления блокировкой сети. Чтобы полностью разблокировать SIM-карту Samsung, вам потребуется разблокировать код «CODE».

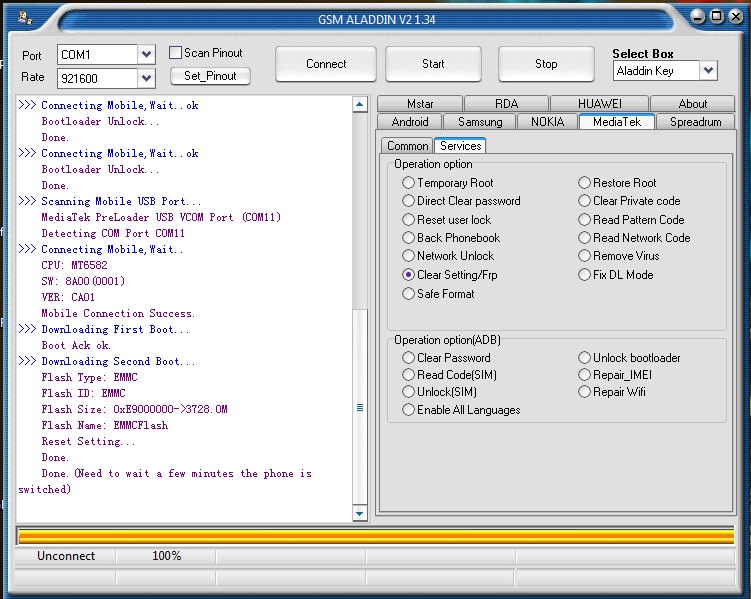

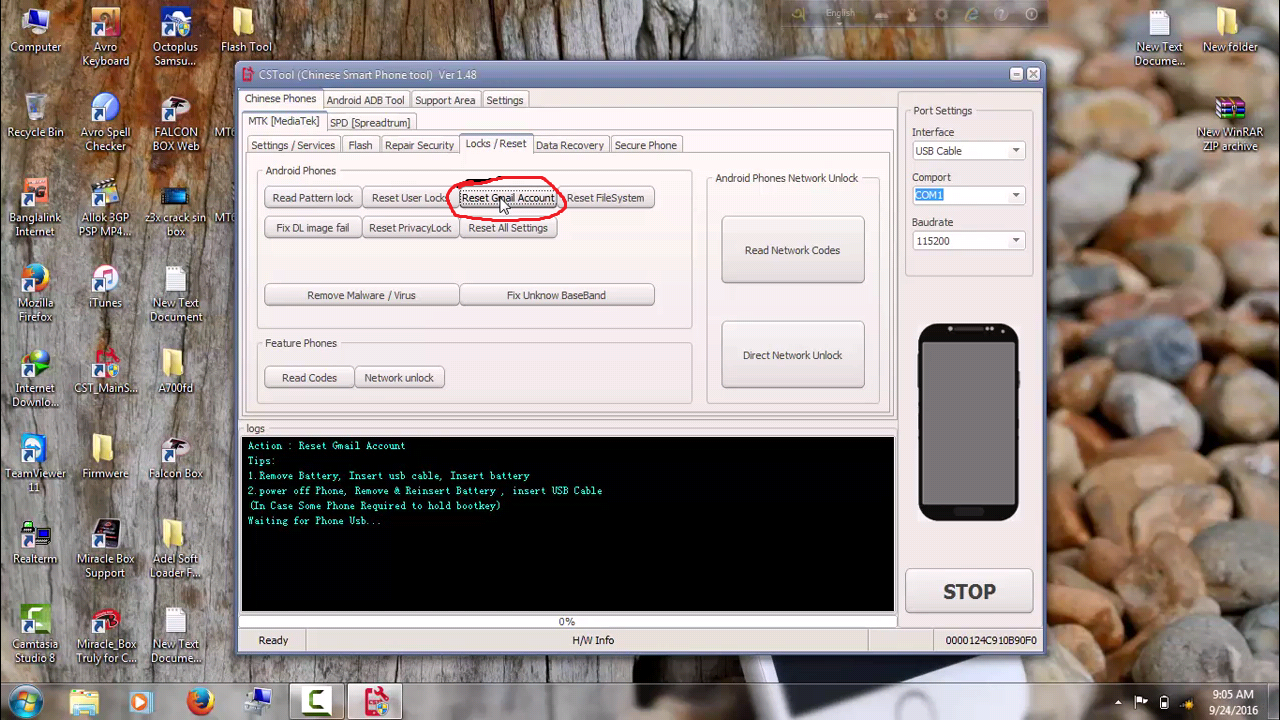

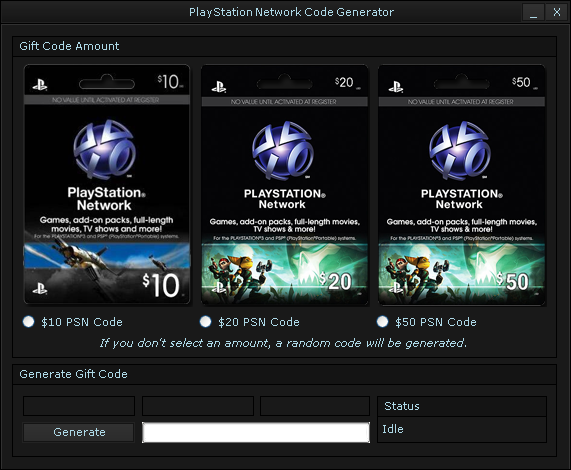

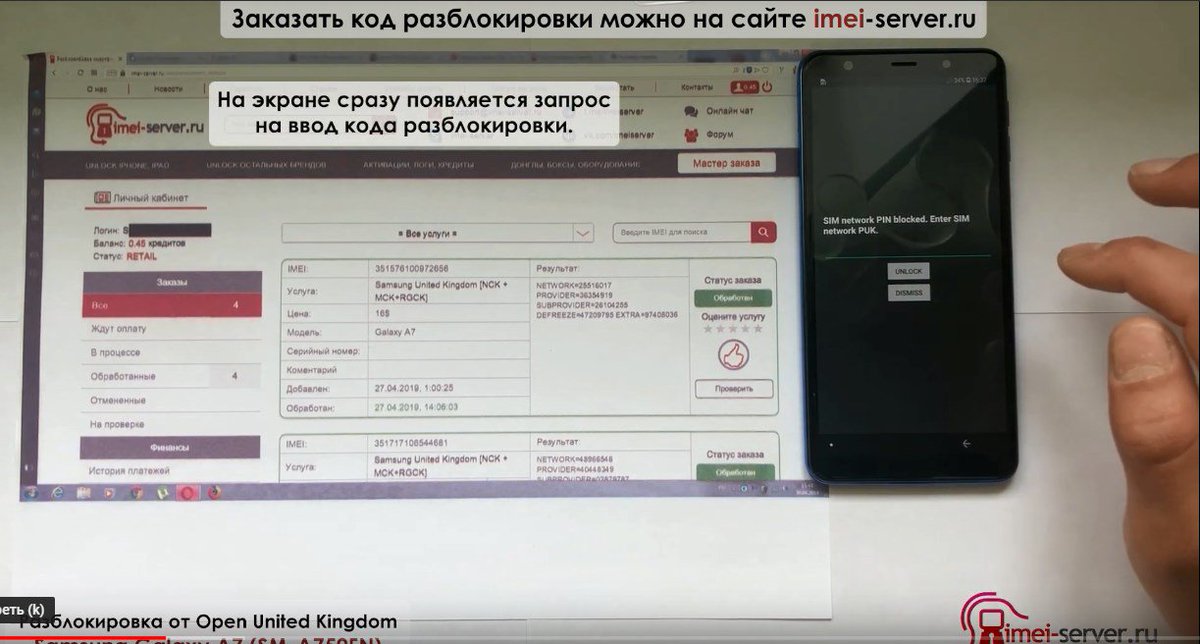

Вот некоторые программы, которые могут разблокировать ваш мобильный телефон Samsung:

World Unlock Codes Calculator

Если вы пользуетесь этой программой, вам не нужно будет искать какой-либо список кодов разблокировки Samsung из Интернета, программа предоставит вам необходимые коды. Инструмент очень прост в эксплуатации и способен обеспечить продуктивные результаты за очень короткий промежуток времени.

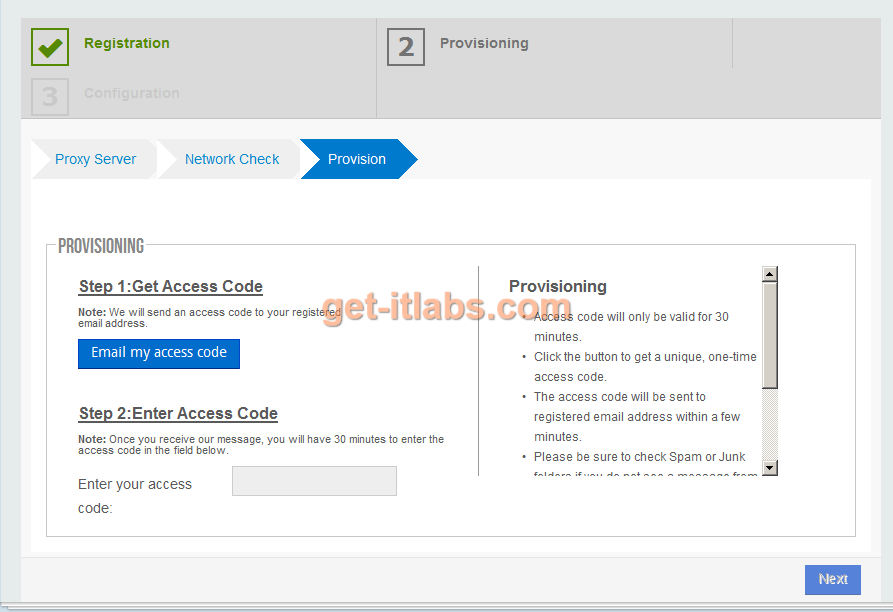

Unlock Samsung Online

Это правильный веб-сайт, который может предоставить вам все необходимые инструкции и информацию о том, как получить код SIM-карты для разблокировки вашего устройства.

Free SIM Unlock Samsung Online

Бесплатная разблокировка SIM-карты Samsung Online, как следует из названия, является эксклюзивным онлайн-генератором кода. Как только вы введете информацию о вашем устройстве, оно начнет генерировать необходимые коды, которые могут разблокировать ваше устройство Samsung.

Free Unlocks

Free Unlocks — отличный веб-сайт, который уже давно предлагает услуги по генерации кода. Это очень эффективно, и многие пользователи сообщили о положительных результатах при использовании этого. У них есть платный сервис, а также бесплатный пробный сервис, известный как TrialPay.

Как видите, вы можете получить такие эффективные программы, чтобы получить бесплатные коды разблокировки Samsung.

Заключение

Все эти методы очень эффективны, если вы собираетесь разблокировать SIM-карту, чтобы использовать другую SIM-карту другого оператора. Но вы должны знать, что для завершения этого процесса необходим код разблокировки, и без этого кода процедура будет неполной, и SIM-карта не сможет разблокироваться.

Если вы также заблокировали свое устройство Android и не можете понять, как обойти экран блокировки, то вы можете использовать программное обеспечение Tenorshare 4uKey for Android, чтобы обойти этот экран блокировки всего несколькими щелчками мыши. Это профессиональная программа разблокировки, которая может легко обойти любой пароль или экран блокировки. Это чрезвычайно простое в использовании и настоятельно рекомендуемое программное обеспечение!

| Номера | Оператор | Регион |

| 904-00xxxxx 01xxxxx 02xxxxx | Tele2 | Тверская область |

| 904-03xxxxx | Tele2 | Владимирская область |

| 904-04xxxxx 05xxxxx 06xxxxx | Tele2 | Нижегородская область |

| 904-07xxxxx | Tele2 | Омская область |

| 904-08xxxxx 09xxxxx | Tele2 | Белгородская область |

| 904-10xxxxx | Tele2 | Республика Коми |

| 904-11xxxxx 12xxxxx 13xxxxx 14xxxxx 15xxxxx | Tele2 | Иркутская область |

| 904-16xxxxx 17xxxxx | МОТИВ | Свердловская область |

| 904-18xxxxx 19xxxxx | Tele2 | Ульяновская область |

| 904-20xxxxx | Tele2 | Республика Коми |

| 904-210xxxx 211xxxx 212xxxx 213xxxx 214xxxx | Tele2 | Воронежская область |

| 904-215xxxx 216xxxx 217xxxx | Tele2 | Санкт-Петербург |

| 904-218xxxx 219xxxx | Tele2 | Липецкая область |

| 904-22xxxxx 23xxxxx | Tele2 | Республика Коми |

| 904-240xxxx 241xxxx 242xxxx 243xxxx 244xxxx | Tele2 | Саратовская область |

| 904-245xxxx 246xxxx 247xxxx 248xxxx 249xxxx | Tele2 | Республика Удмуртия |

| 904-25xxxxx 260xxxx 261xxxx | Tele2 | Владимирская область |

| 904-262xxxx | Tele2 | Санкт-Петербург |

| 904-263xxxx 264xxxx 265xxxx 266xxxx 267xxxx 268xxxx 269xxxx | Tele2 | Пензенская область |

| 904-270xxxx 271xxxx 272xxxx 273xxxx 274xxxx | Tele2 | Республика Коми |

| 904-275xxxx 276xxxx 277xxxx 278xxxx 279xxxx | Tele2 | Республика Удмуртия |

| 904-28xxxxx 29xxxxx | Tele2 | Липецкая область |

| 904-30xxxxx | Tele2 | Челябинская область |

| 904-31xxxxx | Tele2 | Республика Удмуртия |

| 904-32xxxxx | Tele2 | Омская область |

| 904-33xxxxx | Tele2 | Санкт-Петербург |

| 904-34xxxxx | Tele2 | Ростовская область |

| 904-35xxxxx | Tele2 | Тверская область |

| 904-36xxxxx | Tele2 | Смоленская область |

| 904-37xxxxx | Tele2 | Кемеровская область |

| 904-38xxxxx | МОТИВ | Свердловская область |

| 904-39xxxxx | Tele2 | Нижегородская область |

| 904-40xxxxx 41xxxxx 42xxxxx 43xxxxx | Tele2 | Волгоградская область |

| 904-44xxxxx | Tele2 | Ростовская область |

| 904-450xxxx 451xxxx 452xxxx | Tele2 | Ханты-Мансийский АО |

| 904-453xxxx 454xxxx 455xxxx | Tele2 | Ямало-Ненецкий АО |

| 904-456xxxx | Tele2 | Ханты-Мансийский АО |

| 904-457xxxx 458xxxx | Tele2 | Ямало-Ненецкий АО |

| 904-459xxxx 460xxxx | Tele2 | Ханты-Мансийский АО |

| 904-461xxxx 462xxxx 463xxxx | Tele2 | Тюменская область |

| 904-464xxxx 465xxxx 466xxxx 467xxxx 468xxxx 469xxxx 470xxxx 471xxxx 472xxxx | Tele2 | Ханты-Мансийский АО |

| 904-473xxxx 474xxxx | Tele2 | Тюменская область |

| 904-475xxxx | Tele2 | Ямало-Ненецкий АО |

| 904-476xxxx | Tele2 | Тюменская область |

| 904-477xxxx 478xxxx 479xxxx 480xxxx 481xxxx 482xxxx 483xxxx 484xxxx | Tele2 | Ханты-Мансийский АО |

| 904-485xxxx | Tele2 | Ямало-Ненецкий АО |

| 904-486xxxx 487xxxx 488xxxx 489xxxx | Tele2 | Ханты-Мансийский АО |

| 904-49xxxxx | Tele2 | Тюменская область |

| 904-50xxxxx | Tele2 | Ростовская область |

| 904-51xxxxx | Tele2 | Санкт-Петербург |

| 904-52xxxxx | Tele2 | Курская область |

| 904-53xxxxx | Tele2 | Белгородская область |

| 904-54xxxxx | МОТИВ | Свердловская область |

| 904-55xxxxx | Tele2 | Санкт-Петербург |

| 904-566xxxx | МТТ | Москва |

| 904-57xxxxx | Tele2 | Кемеровская область |

| 904-58xxxxx | Tele2 | Омская область |

| 904-59xxxxx | Tele2 | Владимирская область |

| 904-60xxxxx 61xxxxx | Tele2 | Санкт-Петербург |

| 904-62xxxxx | Билайн | Приморский край |

| 904-63xxxxx 64xxxxx | Tele2 | Санкт-Петербург |

| 904-65xxxxx | Tele2 | Владимирская область |

| 904-66xxxxx 67xxxxx | Tele2 | Республика Татарстан |

| 904-68xxxxx 69xxxxx | Tele2 | Липецкая область |

| 904-700xxxx 701xxxx 702xxxx 703xxxx 704xxxx 705xxxx 706xxxx 707xxxx | Билайн | Саратовская область |

| 904-708xxxx 709xxxx 710xxxx 711xxxx | Мегафон | Самарская область |

| 904-712xxxx 713xxxx 714xxxx 715xxxx 716xxxx 717xxxx 718xxxx 719xxxx | ТМТ | Республика Татарстан |

| 904-720xxxx 721xxxx | Мегафон | Республика Мордовия |

| 904-722xxxx 723xxxx | Мегафон | Ульяновская область |

| 904-724xxxx 725xxxx | МТС | Республика Марий Эл |

| 904-726xxxx 727xxxx | Билайн | Чеченская Республика |

| 904-7280xxx 7281xxx 7282xxx 7283xxx 7284xxx | Мегафон | Астраханская область |

| 904-7285xxx 7286xxx 7287xxx 7288xxx 7289xxx | Мегафон | Волгоградская область |

| 904-7290xxx 7291xxx 7292xxx 7293xxx 7294xxx 7295xxx 7296xxx 7297xxx 7298xxx | Мегафон | Самарская область |

| 904-7299xxx | Мегафон | Пензенская область |

| 904-730xxxx 731xxxx 732xxxx 733xxxx 734xxxx | Мегафон | Самарская область |

| 904-735xxxx 736xxxx 737xxxx 738xxxx 739xxxx | МТС | Республика Башкортостан |

| 904-74xxxxx | Мегафон | Самарская область |

| 904-75xxxxx | Tele2 | Волгоградская область |

| 904-76xxxxx | Tele2 | Республика Татарстан |

| 904-77xxxxx | Tele2 | Волгоградская область |

| 904-78xxxxx 79xxxxx | Tele2 | Нижегородская область |

| 904-80xxxxx 81xxxxx | Tele2 | Челябинская область |

| 904-82xxxxx | Tele2 | Омская область |

| 904-83xxxxx | Tele2 | Республика Удмуртия |

| 904-84xxxxx | Tele2 | Пермский край |

| 904-850xxxx 851xxxx 852xxxx 853xxxx 854xxxx 855xxxx | Tele2 | Пензенская область |

| 904-856xxxx | Tele2 | Санкт-Петербург |

| 904-857xxxx 858xxxx 859xxxx | Tele2 | Владимирская область |

| 904-86xxxxx | Tele2 | Республика Коми |

| 904-870xxxx 871xxxx 872xxxx | Tele2 | Ханты-Мансийский АО |

| 904-873xxxx | Tele2 | Тюменская область |

| 904-874xxxx | Tele2 | Ямало-Ненецкий АО |

| 904-875xxxx 876xxxx 877xxxx | Tele2 | Тюменская область |

| 904-878xxxx 879xxxx 880xxxx 881xxxx 882xxxx 883xxxx 884xxxx 885xxxx 886xxxx | Tele2 | Ханты-Мансийский АО |

| 904-887xxxx 888xxxx 889xxxx | Tele2 | Тюменская область |

| 904-89xxxxx | Tele2 | Красноярский край |

| 904-90xxxxx 91xxxxx 92xxxxx | Tele2 | Нижегородская область |

| 904-93xxxxx 940xxxx 941xxxx 942xxxx 943xxxx 944xxxx 945xxxx 946xxxx 947xxxx 948xxxx | Tele2 | Челябинская область |

| 904-949xxxx | Tele2 | Курганская область |

| 904-955xxxx 956xxxx 957xxxx 958xxxx 959xxxx | Tele2 | Владимирская область |

| 904-96xxxxx | Tele2 | Кемеровская область |

| 904-97xxxxx | Tele2 | Челябинская область |

| 904-98xxxxx | МОТИВ | Свердловская область |

| 904-99xxxxx | Tele2 | Кемеровская область |

Грандиозная утечка: Исходный код самой народной версии Windows выложен в Сеть

, Текст: Эльяс Касми

Неизвестные слили в Сеть исходники Windows XP, одной из самых популярных и любимых миллионами ОС Microsoft. Вместе с ними утекли коды Windows Server 2003, а несколько месяцев назад Microsoft допустила утечку кодов Windows NT 3.5 и прошивки консоли Xbox первого поколения.

Windows XP ушла в народ

Корпорация Microsoft допустила утечку исходного кода ОС Windows XP, выпущенной в 2001 г. и на момент публикации материала не поддерживаемой. Как пишет портал Tom’s Hardware, архив с кодом получил распространение среди пользователей анонимного форума 4chan, а сам файл был многократно размещен на различных торрентах и файлообменниках, включая Mega, ранее известный как MegaUpload.

На момент публикации материала представители Microsoft не комментировали утечку. Подлинность выложенных в Сети файлов не была подтверждена или опровергнута.

Бояться почти нечего

Столь крупная утечка Microsoft, даже если все файлы окажутся настоящими, особой опасности сама по себе не представляет. Несмотря на широкую популярность Windows XP в свои годы и даже после релиза в 2007 г. Windows Vista, которую Microsoft готовила на ее замену, в 2020 г. она давно утратила актуальность.

Несмотря на широкую популярность Windows XP в свои годы и даже после релиза в 2007 г. Windows Vista, которую Microsoft готовила на ее замену, в 2020 г. она давно утратила актуальность.

Windows XP стала настоящим хитом Microsoft

По состоянию на август 2020 г. почти 19-летняя Windows XP (она вышла в октябре 2001 г.) была установлена не более чем на 1,16% Windows-компьютерах, согласно статистике StatCounter. Столь незначительным показателям система обязана даже не своим возрастом, а отсутствием технической поддержки – Microsoft прекратила обновлять ее 8 апреля 2014 г.

Ввиду того, что компьютеров на Windows XP практически не осталось, хакеры, по мнению специалистов Tom’s Hardware, с высокой степенью вероятности не станут использовать ее исходный код для новых эксплойтов. В финансовом плане им это будет невыгодно.

В 2020 году про XP почти все позабыли

В то же время информация, которую киберпреступники могут получить из исходного кода Windows XP, может обеспечить им возможность успешного поиска уязвимостей в новых версиях ОС Microsoft.

Стоит добавить: есть вероятность, что архив содержит не весь код операционной системы.

Возможная польза от утечки

Появление в Сети кодов Windows XP имеет и положительную сторону. Ввиду отсутствия ее поддержки со стороны Microsoft все производители компьютерных комплектующих и периферии перестали адаптировать свою продукцию под эту ОС.

Возможно, в архиве есть исходники и других ОС Microsoft

Имея на руках исходники системы, компьютерные энтузиасты получат возможность интегрировать в Windows XP поддержку современного оборудования или заставить корректно работать под ней актуальные версии ПО. Насколько подобные изыскания обоснованы ввиду того, что сама ОС не обновляется более шести лет и, следовательно, имеет массу уязвимостей, неизвестно.

Microsoft регулярно теряет исходники

Для Microsoft появление в интернете исходников ее программных продуктов – не первое за 2020 г. В мае 2020 г. она упустила в Сеть код программного обеспечения игровой приставки Xbox самого первого поколения. Консоль вышла в ноябре 2001 г., почти одновременно с Windows XP, и на момент публикации материала она уже устарела и давно не производится. Как сообщал CNews, в ноябре 2020 г. Microsoft начнет поставки Xbox Series X и Series S – четвертого по счету поколения своей приставки.

Консоль вышла в ноябре 2001 г., почти одновременно с Windows XP, и на момент публикации материала она уже устарела и давно не производится. Как сообщал CNews, в ноябре 2020 г. Microsoft начнет поставки Xbox Series X и Series S – четвертого по счету поколения своей приставки.

Как освободить 2,5 часа в день для каждого сотрудника

Бизнес

Напомним, что программное обеспечение первого Xbox – это ни что иное, как ОС Windows 2000, только сильно модифицированная. Поддержку полноценной Windows 2000 Microsoft прекратила 13 июля 2010 г.

Но утечкой сурс-кода Xbox все не ограничилось. Вместе с ним в распоряжении всех пользователей интернета оказались исходники ОС Windows NT 3.5 – второй операционной системой линейки Windows NT, которую Microsoft выпустила в сентябре 1994 г. Ее поддержка прекращена 31 декабря 2001 г.

Код ТН ВЭД 5608193000. Прочие готовые сети из химических текстильных материалов. Товарная номенклатура внешнеэкономической деятельности ЕАЭС

Позиция ТН ВЭД

|

Позиция ОКПД 2

|

Таможенные сборы — ИМПОРТ

| Базовая ставка таможенной пошлины | 5% реш.54 |

| Акциз | Не облагается |

| НДС | Комплектующие для гражданских воздушных судов Шелк. Федеральный закон 117-ФЗ от 05.08.2000 ГД РФ

0% — авиационные двигатели, запасные части и комплектующие изделия, предназначенные для строительства, ремонта и (или) модернизации на территории Российской Федерации гражданских воздушных судов, при условии представления в таможенный орган документа, подтверждающего целевое назначение ввозимого товара 20% — Прочие |

Рассчитать контракт

Select Option to [. ex-handy-07.com | Выберите Опции: […] Удалить. ex-handy-07.com |

| You can simply place the network code on your site and your […] visitors will see interesting news and new products from MosBuild and our partners. mosbuild.com | Вы можете просто разместить код сети на своем сайте и Ваши посетители […] увидят интересные новости и новинки от MosBuild и […] наших партнеров. mosbuild.com |

They should include a Gas Network Code with rules for access to gas pipelines and [. ..] ..]underground storage, and so on, in line […] with Ukraine’s commitments as a party to the Energy Charter Treaty and its Transit Protocol. c-e-d.info | В такие акты должен входить Кодекс газовых сетей с правилами доступа к газотранспортной […] системе, подземным хранилищам и […] т. п., в соответствии с обязательствами Украины как стороны Договора об Энергетической хартии и Протокола о транзите. c-e-d.info |

Once the voice tone is selected, enter the phone number of a person you want to […] kcell.kz | После выбора голоса необходимо ввести номер абонента, […] kcell.kz |

Prior to PHP 5.3.4, there was […] caused localhost in all stream related […] situations to fail if IPv6 was enabled. php.mirror.range-id.it | До версии PHP […] имени, не дававшая определить адрес localhost при включенном […] IPv6, во всех ситуациях связанных с потоками. php.mirror.range-id.it |

If you would like to see what is going on […] mql5.com | Если вы захотите посмотреть [. mql5.com |

| You can buy tickets at any cashier of the KVITKI BY network, presenting the reservation code. kvitki.by | Выкупить зарезервированный билет Вы можете в любой кассе сети KVITKI BY, предъявив полученный при бронировании код резервации. kvitki.by |

As the quality of Chinese products of Hebei Province network construction of the first electronic monitoring pilot provinces will be completed on June 30 this year, […] the first batch of 69 […] of defective products […] to provide information and technical support. softcov.com | Как качества китайской продукции из провинции Хэбэй строительство сети из первых электронных провинциях пилотного мониторинга будет […] завершен 30 июня этого […] подлинности и вывода […] из эксплуатации дефектных продуктов для обеспечения информационной и технической поддержки. softcov.com |

You can order a melody by calling […] short number 700 (a call […] body of an SMS message to number 700. mts.com.ua | Заказать мелодию Вы можете, позвонив на […] короткий номер 700 (звонок […] SMS на номер 700. mts.com.ua |

This system is convenient when handling […] viva64.com | Эта система удобна при работе с битами и используется в коде, взаимодействующем с сетью […] или внешними устройствами. viva64.com |

Its website provides general information by providing links to Free Economic Zones, and more relevant legislative information such as the Investment Code. 116 It also has a network of regional branches, which may be contacted by investors interested in a particular region of Belarus.117 There is a useful section of the […] 116 It also has a network of regional branches, which may be contacted by investors interested in a particular region of Belarus.117 There is a useful section of the […][…] website on national and state programmes of particular relevance to investors.118 The Chamber of Commerce and Industry provides a service whereby enterprises may advertise their investment projects.119 The projects advertised here are displayed in a similar way to those on the Ministry of Economy’s website, i.e. with expected time frame, payback period and other relevant information for investors. scienceportal.org.by | На сайте ТПП содержится общая информация о стране, ссылки на сайты свободных экономических зон, актуальная правовая информация, включая текст Инвестиционного кодекса115 . scienceportal.org.by |

The IP address is a […] intranet or the Internet. wut.de | IP- адрес представляет собой 32-битовое число, […] wut.de |

From December […] your calls. mts.am | В таком случае бесплатно наберите код *208# и разговаривайте внутри сети ВиваСелл с 21-го декабря по 13-е […] января, по новогодним тарифам — на 20% ниже обычныx. mts.am |

Supported illiterate and semi-literate women in […] for the passage […] of a violence-against-women act. daccess-ods.un.org | Организация оказывала помощь […] неграмотным и […] сетью общественных сельских […] и городских организаций в деле агитации населения за принятие закона о запрещении насилия в отношении женщин. daccess-ods.un.org |

The ICQ Services may share certain non-personally identifiable information about you as an ICQ Services user (such as age or zip code) with certain ad network and service providers, to help them deliver more relevant content and advertisements through their networks. icq.com | Чтобы помочь им предоставлять наиболее актуальный контент и рекламу в своих системах, Сервисы ICQ могут предоставлять этим поставщикам некоторые неперсональные данные о своих пользователях (например, возраст или почтовый индекс). icq.com |

| Soviet building code “Heating network” determines the rough design heat flow for calculation of […] DH heat loads (see table in chapter 2.3). nature-ic.am | Советские строительные нормы по “Отопительным сетям” устанавливают грубые модели теплового потока […] для расчета тепловых нагрузок (см. таблицу в главе 2.3). nature-ic.am |

The campaign was launched on May 16 2009 and includes the [. initiative of 51 member-companies of MGCN to approve and […] moldcell.md | Кампания была запущена 16 мая 2009 года и […] включает инициативу 51 компаний-членов СГПМ […] «GO GREEN». moldcell.md |

| Audit against your code of practice – we monitor your network to ensure compliance with the values and procedures defined in your code of practice sgsgroup.com.ar | Аудит на соответствие своду правил – мы контролируем вашу сеть для обеспечения соответствия ценностям и процедурам, обозначенным в вашем своде правил. sgsgroup.com.ua |

The Committee expresses its concern on numerous reports informing that violence against women, as a form of discrimination, is a widespread problem in the State party and that the law reform process has been […] delayed, namely the amendment of the […] and as a result, a culture of impunity […] towards domestic and gender-based violence has evolved. daccess-ods.un.org | Комитет выражает озабоченность по поводу многочисленных сообщений о том, что насилие в отношении женщин как форма дискриминации является широко распространенной проблемой в государстве-участнике и что процесс […] реформи рования законодательства, а […] Уголовный кодекс и Закон о гражданстве, […] задерживается, следствием чего является утверждение культуры безнаказанности в связи с насилием в семье и насилием по признаку пола. daccess-ods.un.org |

The author stresses that such a petition does not conflict with the Committee’s decision on admissibility of 7 October […] 2009 insofar as the […] considered as an effective […] remedy within the meaning of article 5, paragraph 2 (b), of the Optional Protocol. daccess-ods.un.org | Автор настаивает на том факте, что такое обращение не ставит под вопрос решение Комитета о приемлемости от 7 октября 2009 года, поскольку […] средство правовой защиты, […] в качестве надлежащего […] средства правовой защиты по смыслу пункта 2 b) статьи 5 Факультативного протокола. daccess-ods.un.org |

Welcoming […] (b) speeding up their approval with […] a view to criminalizing acts of torture and conferring on victims compulsory State assistance; such assistance should provide proper redress, including adequate compensation for victims of torture, or other cruel, inhuman or degrading treatment or punishment. daccess-ods.un.org | Приветствуя […] процесс их утверждения […] с целью криминализации актов пытки и предоставления жертвам обязательной государственной помощи; такая помощь должна предусматривать надлежащее возмещение, включая выплату адекватной компенсации жертвам пыток или других видов жестокого, бесчеловечного или унижающего достоинство обращения или наказания. daccess-ods.un.org |

Apart from the earlier areas of activity of the Commission – the ethics of outer space, the ethics of fresh water, the ethics of energy, the ethics of the environment and the ethics of the information society – new themes were analysed such as the ethics of […] nanotechnology, ethics in […] the ethical implications of research […] with human beings in developing countries, and the relationships between the development of science and technology and sustainability. unesdoc.unesco.org | Помимо прежних областей деятельности этой комиссии – этики освоения космоса, этики использования пресной воды, этики использования энергетических ресурсов, этики окружающей среды и этики информационного общества – анализировались новые темы, такие, как этика […] нанотехнологии, этика […] этические последствия исследований, […] проводимых на людях в развивающихся странах, и взаимосвязи между развитием науки и технологии и устойчивостью. unesdoc.unesco.org |

The Sector took the […] to media in open and post-conflict […] situations which comprises national organizations, international NGOs, professional organizations, and members of the United Nations family. unesdoc.unesco.org | Сектор […] кто оказывает помощь средствам информации в условиях […] открытого конфликта и в постконфликтных ситуациях, включая национальные организации, международные НПО, профессиональные объединения и уреждения системы Организации Объединенных Наций. unesdoc.unesco.org |

In line with efforts to enhance the role of libraries and archives as […] access points to […] Library, is developing […] an electronic library user education package to be delivered electronically to the public. unesdoc.unesco.org | Стремясь повышать роль […] сетью (АТИС) и […] Малайзийской национальной библиотекой создают пакет для обучения пользователей работе с электронной библиотекой, который будет распространен среди широких кругов общественности с помощью электронных средств. unesdoc.unesco.org |

Noting its restrictions during interrogations, the […] Committee welcomes […] revision and will […] stipulate that any person being interviewed or interrogated by the police will have the right to have a lawyer present during the first police investigation. daccess-ods.un.org | Обращая внимание на ограничения этого права во время допросов, Комитет приветствует сообщение государства-участника о том, что в настоящее […] время производится […] право любого опрашиваемого […] или допрашиваемого полицией лица на присутствие адвоката на первом допросе в полиции. daccess-ods.un.org |

The task of preserving, developing and disseminating the history, culture, language, traditions and customs of all the nationalities and ethnic groups living in Turkmenistan is undertaken by 753 cultural centres […] (palaces and houses of culture, arts […] establishments in the country, [. where representatives of various nationalities and ethnic groups work alongside representatives of indigenous ethnic groups. daccess-ods.un.org | Задачам сохранения, развития и распространения истории, культуры, языка, традиций и обрядов всех национальностей и этнических групп, проживающих в Туркменистане, […] способствуют 753 культурных центра […] сеть учебных заведений […] культуры и искусства, действующих в Туркменистане, в которых обучаются и работают наряду c представителями коренной национальности представители других национальностей и этнических групп. daccess-ods.un.org |

The Revised Family Code prohibited polygamous marriage, and all the regional states except Afar and Somali had enacted family codes that were compatible with that revised federal law. daccess-ods.un.org | Новый Семейный кодекс запрещает полигамные браки, и все штаты, кроме Афары и Сомали, приняли семейные кодексы, соответствующие федеральному законодательству. daccess-ods.un.org |

| For instance, the United Kingdom’s Office of Fair Trading (OFT) Consumer Codes Approval Scheme (CCAS) grants its approval to groups of businesses, via their trade association, that voluntarily undertake a code of conduct that promotes or protects consumer interests, and which meets with the criteria set by the OFT to govern the scheme. daccess-ods.un.org | Например, в соответствии с Системой утверждения потребительских кодексов (СУПК) Управления по добросовестной торговле (УДТ ) Соединенного Королевства предусматривается утверждение принимаемых группами предприятий через их отраслевые ассоциации добровольных кодексов поведения, поощряющих или защищающих интересы потребителей и отвечающих критериям регулирования этой системы, установленным УДТ. daccess-ods.un.org |

The Education Sector has developed a comprehensive implementation strategy for the implementation of the United States contribution to the reconstruction of education systems in postconflict countries, which will cover the following areas: (1) development of national Education for All plans, (2) training of teachers and education personnel, (3) development of curricula, […] textbook and examination support, (4) HIV/AIDS education, (5) government […] unesdoc.unesco.org | Сектор образования разработал всеобъемлющую стратегию по использованию взноса Соединенных Штатов Америки на цели восстановления систем образования в странах, выходящих их конфликтов, которая охватывает следующие области: (1) разработка национальных планов по ОДВ; (2) подготовка преподавателей и педагогического персонала; (3) разработка учебных программ и планов, подготовка учебников и оказание [. поддержки в тестировании успеваемости; […] потенциала правительств и (6) укрепление сетей. unesdoc.unesco.org |

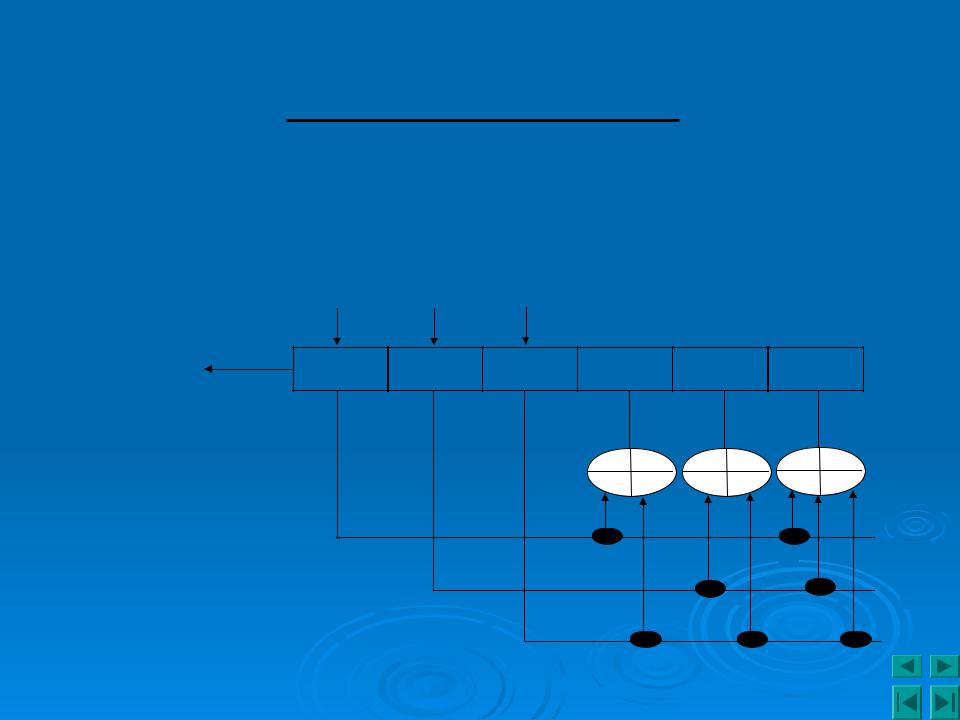

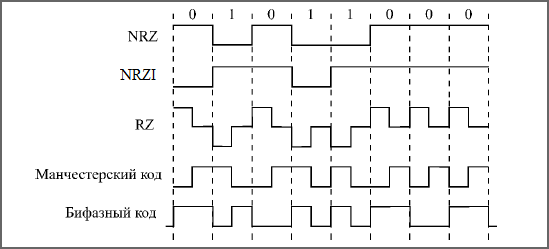

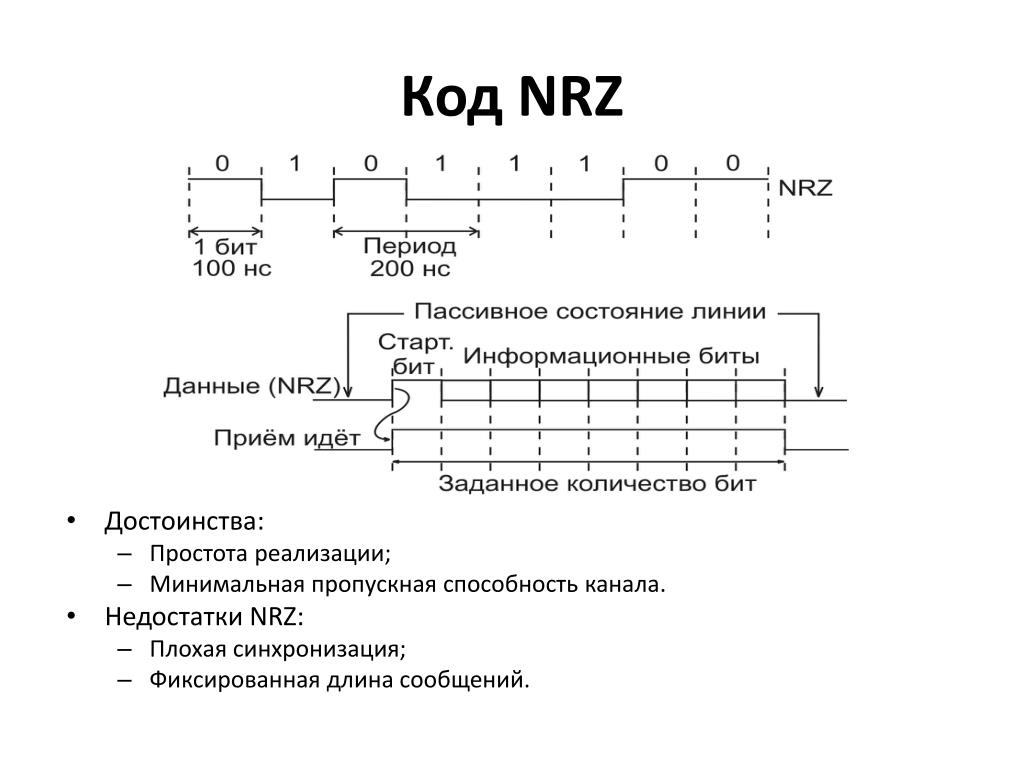

Избыточный код 4В/5В | Компьютерные сети

Избыточные коды основаны на разбиении исходной последовательности битов на порции, которые часто называют символами. Затем каждый исходный символ заменяется новым с большим количество битов, чем исходный.

Например, в логическом коде 4В/5В, используемом в технологиях FDDI и Fast Ethernet, исходные символы длиной 4 бит заменяются символами длиной 5 бит. Так как результирующие символы содержат избыточные биты, то общее количество битовых комбинаций в них больше, чем в исходных. Так, в коде 4В/5В результирующие символы могут содержать 32 битовые комбинации, в то время как исходные символы — только 16 (cм. табл.1).

Поэтому в результирующем коде можно отобрать 16 таких комбинаций, которые не содержат большого количества нулей, а остальные считать запрещенными кодами (code violations). Помимо устранения постоянной составляющей и придания коду свойства самосинхронизации, избыточные коды позволяют приемнику распознавать искаженные биты. Если приемник принимает запрещенный код, значит, на линии произошло искажение сигнала.

Помимо устранения постоянной составляющей и придания коду свойства самосинхронизации, избыточные коды позволяют приемнику распознавать искаженные биты. Если приемник принимает запрещенный код, значит, на линии произошло искажение сигнала.

После разбиения получившийся код 4В/5В передается по линии путем преобразования с помощью какого-либо из методов потенциального кодирования, чувствительного только к длинным последовательностям нулей. Таким кодом является, например, код NRZI.

Символы кода 4В/5В длиной 5 бит гарантируют, что при любом их сочетании на линии не встретятся более трех нулей подряд.

Таблица 1. Соответствие исходных и результирующих кодов 4В/5В

Исходный код Результирующий код Исходный код Результирующий код

| Исходный код | Результирующий код | Исходный код | Результирующий код |

| 0000 | 11110 | 1000 | 10010 |

| 0001 | 01001 | 1001 | 10011 |

| 0010 | 10100 | 1010 | 10110 |

| 0011 | 10101 | 1011 | 10111 |

| 0100 | 01010 | 1100 | 11010 |

| 0101 | 01011 | 1101 | 11011 |

| 0110 | 01110 | 1110 | 11100 |

| 0111 | 01111 | 1111 | 11101 |

ПРИМЕЧАНИЕ

Буква В в названии кода 4В/5В означает, что элементарный сигнал имеет два состояния (от английского binary — двоичный). Имеются также коды и с тремя состояниями сигнала, например в коде 8В/6Т для кодирования 8 бит исходной информации используется код из 6 сигналов, каждый из которых имеет три состояния. Избыточность кода 8В/6Т выше, чем кода 4В/5В, так как на 256 исходных кодов приходится З6 — 729 результирующих символов.

Имеются также коды и с тремя состояниями сигнала, например в коде 8В/6Т для кодирования 8 бит исходной информации используется код из 6 сигналов, каждый из которых имеет три состояния. Избыточность кода 8В/6Т выше, чем кода 4В/5В, так как на 256 исходных кодов приходится З6 — 729 результирующих символов.

Использование таблицы перекодировки является очень простой операцией, поэтому этот подход не усложняет сетевые адаптеры и интерфейсные блоки коммутаторов и маршрутизаторов.

Для обеспечения заданной пропускной способности линии передатчик, использующий избыточный код, должен работать с повышенной тактовой частотой. Так, для передачи кодов 4В/5В со скоростью 100 Мбит/с требуется тактовая частота 125 МГц. При этом спектр сигнала на линии расширяется по сравнению со случаем, когда по линии передается не избыточный код. Тем не менее спектр избыточного потенциального кода оказывается уже спектра манчестерского кода, что оправдывает дополнительный этап логического кодирования, а также работу приемника и передатчика на повышенной тактовой частоте.

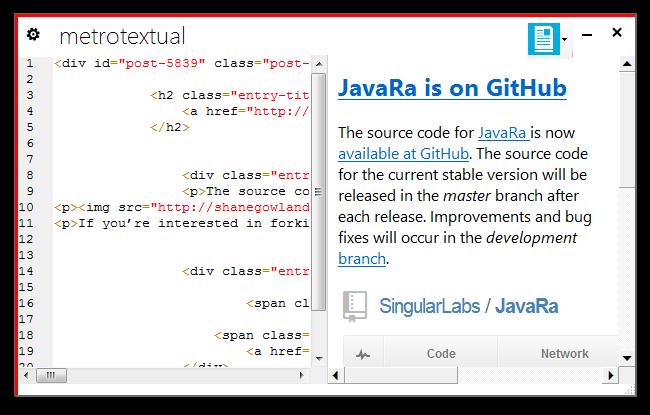

Что означает «Сеть как код»?

Куда бы вы ни обратились в сфере ИТ сегодня, влияние DevOps и Cloud можно увидеть и почувствовать. И на это есть веские причины. Огромные преимущества, которые были получены благодаря гибким процессам, автоматизации и культуре разработки программного обеспечения, неоспоримы. Это был лишь вопрос времени, когда традиционные области инфраструктуры почувствуют необходимость учиться и адаптироваться. Концепция «Инфраструктура как код» (IaC) — одна из таких областей, которая имеет значительный потенциал нарушить и изменить способ проектирования и настройки сети.

«Сеть как код» — это приложение более общей концепции IaC к конкретной области сетей.

Сеть как код — это применение концепции «Инфраструктура как код» во всем сетевом домене.

«Инфраструктура как код» — это название, данное методам, используемым для описания и предоставления вычислительных, хранилищ, сетевых и других ресурсов в рамках развертывания современных приложений на облачных платформах. С помощью IaC разработчики встраивают требования инфраструктуры для приложения вместе с кодом приложения в репозитории системы контроля версий. Эти требования представлены в форматах данных, которые могут быть легко обработаны с помощью инструмента развертывания инфраструктуры. Хотя существует множество инструментов для развертывания IaC, наиболее распространенным многоплатформенным инструментом является Terraform от Hashicorp. С помощью Terraform инфраструктуру приложения можно быстро создать, обновить, уничтожить и воссоздать на основе «конфигурации», управляемой версиями, вместе с самим приложением. Кроме того, инструменты непрерывной разработки (CICD) могут выполнять управление инфраструктурой как часть конвейера сборки.

С помощью IaC разработчики встраивают требования инфраструктуры для приложения вместе с кодом приложения в репозитории системы контроля версий. Эти требования представлены в форматах данных, которые могут быть легко обработаны с помощью инструмента развертывания инфраструктуры. Хотя существует множество инструментов для развертывания IaC, наиболее распространенным многоплатформенным инструментом является Terraform от Hashicorp. С помощью Terraform инфраструктуру приложения можно быстро создать, обновить, уничтожить и воссоздать на основе «конфигурации», управляемой версиями, вместе с самим приложением. Кроме того, инструменты непрерывной разработки (CICD) могут выполнять управление инфраструктурой как часть конвейера сборки.

В большинстве случаев IaC используется сегодня в облачных средах, где требования к инфраструктуре для приложения были разработаны вместе с приложениями, которые были созданы для облака или перенесены в облако. Гораздо реже можно увидеть использование настоящей «инфраструктуры как кода» для традиционных центров обработки данных, университетских городков или сред глобальной сети сегодня, но я считаю, что мы движемся в этом направлении.

«Сеть как код» (NaC) — это применение концепции «Инфраструктура как код» ко всему сетевому домену, включая традиционные центры обработки данных, университетские сети, глобальные сети и, конечно же, облачные среды. Успешное внедрение NaC является частью более широкого внедрения NetDevOps на предприятии. Это потребует значительных изменений в нашем подходе к проектированию и эксплуатации сети, культуре, связанной с изменением сети, и, конечно же, в инструментах и технологиях, используемых для создания конфигураций и управления ими. Я предлагаю три принципа для сети как кода в NetDevOps.

Принципы сети как код

- Сохранение сетевых конфигураций в системе управления версиями

- Контроль источников — единственный источник истины

- Развертывание конфигураций с программными API

Давайте рассмотрим каждый из этих принципов более подробно.

Если мы собираемся использовать стратегию «Сеть как код», нам нужно рассматривать конфигурации сети как код, а код хранится в системе управления версиями. В данном случае я имею в виду такие системы контроля версий, как «git». Решения для управления версиями, также называемые контролем версий, позволяют эффективно отслеживать изменения файлов в «репозиториях кода» с помощью инструментов, позволяющих разработчикам легко работать над своими проектами. «Распределенный контроль версий» — это наиболее распространенная реализация системы управления версиями, наблюдаемая сегодня, и она позволяет совместно использовать репозитории среди членов команды, «проталкивая» изменения в центральное удаленное место, откуда другие разработчики могут «тянуть» на свои локальные рабочие станции. .

В данном случае я имею в виду такие системы контроля версий, как «git». Решения для управления версиями, также называемые контролем версий, позволяют эффективно отслеживать изменения файлов в «репозиториях кода» с помощью инструментов, позволяющих разработчикам легко работать над своими проектами. «Распределенный контроль версий» — это наиболее распространенная реализация системы управления версиями, наблюдаемая сегодня, и она позволяет совместно использовать репозитории среди членов команды, «проталкивая» изменения в центральное удаленное место, откуда другие разработчики могут «тянуть» на свои локальные рабочие станции. .

Переходя к системам управления версиями, мы оставляем позади более «традиционные» методы управления версиями в пространстве конфигурации сети. Я, конечно, имею в виду общие стратегии именования файлов «switch2-V1.txt», «switch2-V2.txt», «switch2-V3.txt» и так далее. Этот метод контроля версий подвержен ошибкам, неточен и не имеет каких-либо методов контроля. Однако с системой управления версиями все версии по своей сути хранятся в истории репозитория вместе с такими деталями, как кто внес изменения, когда было внесено изменение и причины изменения.Более того, в любой момент вы можете быстро увидеть различия между разными версиями и даже «откатиться» к любому моменту времени с помощью одной команды управления версиями.

Однако с системой управления версиями все версии по своей сути хранятся в истории репозитория вместе с такими деталями, как кто внес изменения, когда было внесено изменение и причины изменения.Более того, в любой момент вы можете быстро увидеть различия между разными версиями и даже «откатиться» к любому моменту времени с помощью одной команды управления версиями.

Наряду с базовой системой управления версиями, такой как git, используется платформа для предоставления общего доступа к репозиториям внутри группы. Такие продукты, как GitHub, GitLab, BitBucket, Gogs и т. Д., Предоставляют реализацию git на веб-портале, где команды могут делиться репозиториями проектов. Но эти решения предлагают гораздо больше, чем просто централизованное удаленное расположение репозиториев.Они также включают функции совместной работы, такие как ведение журнала проблем, отслеживание выпусков, вики-страницы с документацией, доски управления проектами и многое другое. Это означает, что успешные команды NetDevOps могут использовать обзоры кода, журналы проблем, запросы на вытягивание и выпуски так же, как успешные команды разработчиков программного обеспечения.

Теперь, когда наши сетевые конфигурации надежно хранятся в системе управления версиями, мы должны рассматривать систему управления версиями как единственный источник достоверной информации о том, как должна быть настроена сеть.Сегодня во многих организациях источником достоверной информации о конфигурации сети является текущая конфигурация сети, которая активна в производственной сети. Это дает то преимущество, что работающая сеть всегда «точна», однако это ужасный способ управления в современной методологии «Инфраструктура как код».

Частично причина, по которой принципы «Инфраструктура как код» в облачных приложениях, заключается в способности быстро и эффективно создавать новые экземпляры инфраструктуры, необходимые для приложения в различных средах.Типичные приложения будут иметь производственную среду, среду тестирования, среду контроля качества (QA), а также среду разработки, в которой будет работать каждый активный разработчик. Используя методы IaC, каждая создаваемая среда будет построена таким же образом с использованием одних и тех же определений конфигурации, ограничивая различия между ними до минимума. Это значительно увеличивает количество успешных развертываний и обновлений приложений за счет устранения вариаций среды. Причина, по которой это работает, заключается в том, что конфигурация IaC, хранящаяся в системе управления версиями, является источником истины для того, как должна быть настроена инфраструктура.

Это значительно увеличивает количество успешных развертываний и обновлений приложений за счет устранения вариаций среды. Причина, по которой это работает, заключается в том, что конфигурация IaC, хранящаяся в системе управления версиями, является источником истины для того, как должна быть настроена инфраструктура.

Хотя большинство предприятий еще не имеют возможности иметь такой надежный набор сред тестирования, разработки и контроля качества для своей сети в целом, для того, чтобы воплотить это в жизнь, проводится значительная работа. Инструменты сетевого моделирования, виртуальные сетевые функции, эмуляторы и облачные решения становятся доступными, поэтому я предвижу тот день, когда предприятие сможет создать «тестовую сеть», которая будет представлять любую часть их сети.

И хотя мы еще не достигли этого, это не оправдание, чтобы не приступить к построению дисциплины «Сеть как код» и NetDevOps сегодня.Это означает, что «правильная» сетевая конфигурация должна быть той, что хранится в системе управления версиями и помечена как «производственная» версия. Любые органические вариации, реализованные вручную ошибочным инженером через SSH и CLI, являются отклонениями и неверны. Используя NaC, мы должны быть уверены, что в любой момент времени мы сможем реализовать конфигурацию, хранящуюся в системе контроля версий, в нашей производственной сети. Фактически, мы должны реализовать процедуры, которые отслеживают отклонения в работающих конфигурациях, генерируют предупреждения и возвращаются к заведомо исправным конфигурациям из системы контроля версий.

Любые органические вариации, реализованные вручную ошибочным инженером через SSH и CLI, являются отклонениями и неверны. Используя NaC, мы должны быть уверены, что в любой момент времени мы сможем реализовать конфигурацию, хранящуюся в системе контроля версий, в нашей производственной сети. Фактически, мы должны реализовать процедуры, которые отслеживают отклонения в работающих конфигурациях, генерируют предупреждения и возвращаются к заведомо исправным конфигурациям из системы контроля версий.

Последний принцип «Сеть как код» касается того, как конфигурации из системы управления версиями фактически применяются к самим сетевым устройствам. Как упоминалось в предыдущем принципе, ручная настройка сетевых инженеров является отклонением и ошибкой в мире сети как кода. Человеческий фактор в управлении конфигурацией сети проявляется в проектировании, разработке и тестировании конфигурации сети как кода. Фактическая реализация «кода» должна осуществляться через программные API.

Есть много причин, по которым этот принцип так важен, но все они сводятся к двум пунктам: согласованность и шкала . Человеческий разум — это удивительно умная и творческая сила природы, однако ему также легко надоесть, он ужасен мельчайшими деталями и не приспособлен для повторяющихся задач. Выполнение и реализация сетевой конфигурации во всей сети — это то, что подчеркнет все человеческие слабости. К счастью, компьютеры не надоедают, отлично разбираются в деталях и специально разработаны для повторяющихся задач — и этот третий принцип использует этот факт.

Человеческий разум — это удивительно умная и творческая сила природы, однако ему также легко надоесть, он ужасен мельчайшими деталями и не приспособлен для повторяющихся задач. Выполнение и реализация сетевой конфигурации во всей сети — это то, что подчеркнет все человеческие слабости. К счастью, компьютеры не надоедают, отлично разбираются в деталях и специально разработаны для повторяющихся задач — и этот третий принцип использует этот факт.

Итак, если мы согласны с тем, что компьютеры лучше подходят для развертывания конфигураций в сети, имеет смысл только то, что мы используем интерфейсы, которые лучше всего подходят для компьютеров, а не для людей. Это, конечно, означает, что с помощью Network as Code мы оставим CLI в качестве основного метода развертывания сетевых конфигураций и перейдем к API, таким как новые стандарты NETCONF и RESTCONF или API собственной платформы.

Однако на данном этапе мы должны также принять во внимание немного реальности.Современные программные API-интерфейсы все еще относительно новы в сетевой инфраструктуре, и многие из нас имеют сети, построенные на платформах, которые могут не иметь интерфейса, отличного от интерфейса командной строки (или SNMP, который имеет свои собственные проблемы для настройки). Этот факт не , а не мешает нам начать движение к «Сети как коду» и NetDevOps. Это просто означает, что в какой-то момент нам в некоторых случаях потребуется использовать CLI в качестве программного API. Как только устаревшие платформы будут обновлены (программно или аппаратно) и получат лучший выбор API, мы сможем обновить наши стратегии развертывания.

Этот факт не , а не мешает нам начать движение к «Сети как коду» и NetDevOps. Это просто означает, что в какой-то момент нам в некоторых случаях потребуется использовать CLI в качестве программного API. Как только устаревшие платформы будут обновлены (программно или аппаратно) и получат лучший выбор API, мы сможем обновить наши стратегии развертывания.

В этом сообщении в блоге я хотел начать изучение того, как концепции «Инфраструктура как код» будут связаны с более широкой сетью, поскольку мы начинаем полностью внедрять NetDevOps и переходим к «Сеть как код». Если вы спрашиваете себя, что такое «NetDevOps», просмотрите части 1 и 2 моих блогов по этой теме. По мере того, как мы движемся в этом направлении, нужно рассмотреть еще много тем, так что ищите больше блогов! Далее будет обсуждение концепций и инструментов управления конфигурацией, а также того, что они предлагают сети.

Если вам нравится то, что вы прочитали, и вы хотите увидеть еще немного. Посмотрите это видео NetDevOps, где я немного демонстрирую «Сеть как код в действии».

Посмотрите это видео NetDevOps, где я немного демонстрирую «Сеть как код в действии».

Поделиться:

Кодекс поведения PlayStation ™ Network

Кодекс поведения сообщества

PSN предназначен для всех, независимо от расы, гендерной идентичности, сексуальной ориентации, этнической принадлежности, национальности, цвета кожи, иммиграционного статуса, социального и экономического класса, уровня образования, размера, семейного положения, политических убеждений, религии, умственных и физических способностей или любых других другой атрибут, который люди используют, чтобы навешивать ярлыки на других или разделять сообщества.

Чтобы PSN оставалась лучшим местом для игры для всех, важно, чтобы все наши пользователи уважали права других и воздерживались от неправомерного использования PSN. Соответственно, когда вы создаете Учетную запись, вы соглашаетесь с тем, что вы (и ваш Ребенок, если создаете Дочернюю Учетную запись) будете следовать правилам, изложенным ниже.

Соответственно, когда вы создаете Учетную запись, вы соглашаетесь с тем, что вы (и ваш Ребенок, если создаете Дочернюю Учетную запись) будете следовать правилам, изложенным ниже.

5.1. Не создавайте группы ненависти, не используйте и не поощряйте язык вражды.

5.2. Не угрожайте, не причиняйте вреда, не запугивайте, не преследуйте, не троллите и не преследуйте кого-либо и не поощряйте кого-либо к этому.

5.3. Запрещается создавать, загружать, транслировать или передавать какие-либо изображения, аудио или другой контент или сообщения, которые являются расистскими или оскорбительными по отношению к какой-либо этнической принадлежности, гендерной идентичности, сексуальной ориентации, национальности или религии, или которые унижают кого-либо на основании их умственных или физических возможностей , внешность или другие личные качества.

5.4. Не создавайте, не загружайте, не транслируйте или не обменивайтесь сообщениями, изображениями, аудио или другим контентом или сообщениями, которые являются непристойными или содержат графические материалы сексуального характера или отвратительные насильственные материалы.

5.5. Не участвуйте, не угрожайте и не поощряйте незаконную деятельность, терроризм, акты насилия или членовредительства.

5.6. Не порочите и не распространяйте ложь о ком-либо, а также не создавайте, не изменяйте, не загружайте, не транслируйте и не делитесь изображениями или аудио другими людьми без их согласия.

5.7. Не раскрывайте личную информацию (например, номера телефонов, адреса электронной почты, IP- или MAC-адреса или реальные адреса) о себе или другом человеке.

5.8. Не манипулируйте и не преувеличивайте использование PSN, а также не нарушайте нормальный ход чата или игрового процесса.

5.9. Не делитесь, не покупайте, не продавайте, не сдавайте в аренду, не сублицензируйте, не обменивайте, не передавайте, не используйте фишинг и не собирайте какие-либо учетные записи, данные учетной записи или другие учетные данные.

5.10. Не обманывайте и не используйте какие-либо ошибки, сбои, уязвимости или непреднамеренные механизмы в Контенте или PSN для получения преимущества или для получения несанкционированного доступа к Контенту.

5.11. Не загружайте, не публикуйте, не транслируйте и не передавайте любой контент, содержащий вирусы, черви, шпионское ПО, бомбы замедленного действия или другие компьютерные программы, которые могут повредить PSN, помешать ей или нарушить ее работу.

5.12. Запрещается использовать, создавать и распространять неавторизованное программное обеспечение или оборудование, включая нелицензионные периферийные устройства и программное обеспечение с чит-кодом или устройства, которые обходят любые функции безопасности или ограничения, включенные в какое-либо программное обеспечение или устройства, а также принимать или использовать какие-либо данные из PSN для проектирования, разработки или обновлять неавторизованное программное обеспечение или оборудование.

5.13. Не предоставляйте читы, технические средства или другие методы, предназначенные для обеспечения или поощрения любого сбора, продажи или обмена Контентом PSN, включая любую виртуальную валюту, товары или эффекты, такие как монеты, баллы, жетоны, золото, драгоценные камни, оружие, транспортные средства, баффы, бонусы, трофеи, награды или значки («Виртуальные предметы»). Не создавайте и не участвуйте в любом использовании разницы в ценах Виртуальных предметов (например, между ценами на реальные деньги в валюте).

Не создавайте и не участвуйте в любом использовании разницы в ценах Виртуальных предметов (например, между ценами на реальные деньги в валюте).

5.14. Не пытайтесь взломать или реконструировать какой-либо код или оборудование, используемое в PSN или связанное с ним, или пытаться изменить онлайн-клиент, диск, файл сохранения, сервер, связь клиент-сервер или другие части любого названия игры или содержимого. .

5.15. Не нарушайте работу, не изменяйте и не повреждайте любую Учетную запись, систему, оборудование, программное обеспечение или сеть, подключенные или предоставленные PSN, по любой причине, в том числе с целью получения несправедливого преимущества в игре.

5.16. Не рассылайте СПАМ, не загружайте и не делитесь контентом коммерческого характера, например рекламными объявлениями, предложениями, рекламными акциями и ссылками на веб-сайты.

5.17. Не загружайте и не делитесь контентом, который может нанести вред компании SIE, ее аффилированным лицам, их лицензиарам или игрокам, например, кодам или вирусам, которые могут повредить, изменить или изменить какую-либо собственность или помешать использованию собственности или PSN.

5.18. Не участвуйте, не продвигайте и не содействуйте деятельности, которая нарушает права какой-либо третьей стороны или нарушает какой-либо закон или постановление, а также договорные или фидуциарные обязательства.

5.19. Не крадите чью-либо личность, не выдавайте себя за кого-либо и не применяйте мошеннические, вводящие в заблуждение или вводящие в заблуждение действия.

5.20. Не создавайте профиль учетной записи или сетевой идентификатор для PSN, нарушающий настоящий Кодекс поведения.

5.21. Не отправляйте ложные сообщения о горе и не злоупотребляйте системой сообщений о горе иным образом.

5.22. Не грубо, не оскорбляйте и не угрожайте нашим сотрудникам, агентам или представителям. Если вы это сделаете, в дополнение к любым другим действиям, которые мы можем предпринять в соответствии с настоящим Соглашением, мы можем ограничить вас возможностью связаться с нами по электронной почте или отказать вам в дальнейшей поддержке потребителей.

Нарушение нашего Кодекса поведения может привести к модерации вашей учетной записи или ваших устройств PlayStation (см. Раздел 12 для получения дополнительной информации). Мы также можем уведомить правоохранительные органы (или другое соответствующее государственное учреждение), если нарушение связано с угрозой жизни или безопасности вас или других, или любой другой деятельностью, которую мы считаем незаконной.

Раздел 12 для получения дополнительной информации). Мы также можем уведомить правоохранительные органы (или другое соответствующее государственное учреждение), если нарушение связано с угрозой жизни или безопасности вас или других, или любой другой деятельностью, которую мы считаем незаконной.

Мы не несем ответственности за мониторинг или запись любых действий или сообщений в PSN, хотя мы можем делать это для расследования нарушений или обеспечения соблюдения настоящего Соглашения, а также для защиты прав и собственности SIE, ее партнеров и клиентов.Если вы стали свидетелем или столкнулись с каким-либо нарушением этого Кодекса другим игроком, вы должны немедленно сообщить о нем, используя наши инструменты для сообщения о горе. Для получения дополнительной информации о сообщениях о горе посетите www.playstation.com/safety. Мы не несем ответственности за нарушение данного соглашения вами или любым другим пользователем PSN.

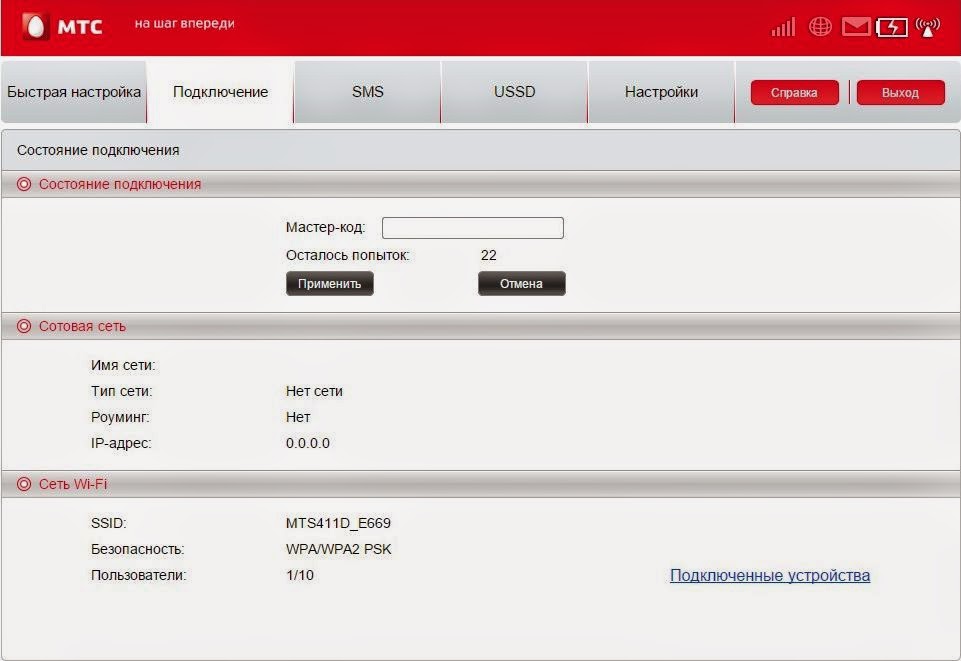

Код подключения по запросу

Ниже вы найдете часто задаваемые вопросы, касающиеся сетевого кода Код подключения по запросу.

Сетевой кодекс подключения по требованию поможет выполнить задачи по содействию увеличению возобновляемых источников энергии (ВИЭ), обеспечению безопасности системы и реализации внутреннего рынка электроэнергии, в том числе с помощью моделей интеллектуальных сетей, для определения которых была инициирована DCC. общие функциональные требования и будут в основном ориентированы на подключение промышленных нагрузок и распределительных сетей.

Последнее обновление статуса (декабрь 2015 г.)

В октябре 2015 г. государства-члены, собравшиеся в комитологии, положительно проголосовали за новый кодекс HVDC. Теперь кодекс будет рассмотрен Европейским парламентом и Советом, и ENTSO-E надеется, что он вступит в силу весной 2016 года.

Проект кодекса и все связанные с ним документы можно скачать по ссылкам в таблице ниже. Доступен обзор последних разработок для всех сетевых кодов.

Окончательный код и сопроводительные документы доступны внизу этой страницы.

DCC является неотъемлемой частью большого пакета разрабатываемых сетевых кодов. В нем также рассматриваются некоторые сложные аспекты меняющейся роли и характера спроса на электроэнергию. Для получения дополнительной информации об этом и о процессе разработки DCC, пожалуйста, прочтите «справочную информацию»

В нем также рассматриваются некоторые сложные аспекты меняющейся роли и характера спроса на электроэнергию. Для получения дополнительной информации об этом и о процессе разработки DCC, пожалуйста, прочтите «справочную информацию»

Что произойдет дальше?

Сетевые коды были разработаны, чтобы помочь реализовать три цели европейской политики в области энергетики — обеспечение безопасности поставок; создание конкурентного внутреннего рынка электроэнергии; и декарбонизация электроэнергетики. Чтобы это произошло, необходимо внедрить и соблюдать сетевые коды по всей Европе.

ENTSO-E опубликовал руководство по внедрению кода подключения по требованию (DCC). DCC предлагает сбалансированную структуру, в которой одни параметры в коде устанавливаются на европейском уровне, а другие — на национальном уровне, исходя из потребностей местной системы. Рекомендации по внедрению поддерживают код, подчеркивая влияние на конкретные технологии, связь с характеристиками локальной сети, а также необходимость координации между операторами сети и пользователями сети.

Загрузить Руководство по внедрению DCC (16.10.2013)

Каждая сеть требует выполнения ряда шагов, прежде чем они вступят в силу.Это могут быть национальные решения, заключение региональных соглашений или создание более детальных методологий. Все участники рынка, DSO, TSO и регулирующие органы будут задействованы, и потребуются обширные разработки и консультации.

Сетевые коды, связанные с подключением, используют гибкую структуру, которая позволяет устанавливать некоторые значения на национальной основе в пределах диапазонов, указанных в сетевых кодах, в то время как другие вопросы решаются на общеевропейской основе. Такой подход отражает тот факт, что инфраструктура передачи электроэнергии во многих европейских странах развивалась по-разному.

Взаимодействие с заинтересованными сторонами

Взаимодействие с заинтересованными сторонами ENTSO-E включало в себя семинары с участием заинтересованных сторон, встречи группы технических экспертов DSO, встречи групп пользователей, общий призыв к участию заинтересованных сторон, а также специальные встречи и обмен мнениями с любой заинтересованной стороной, а также подходящее. Группы технических экспертов DSO отражают важность привлечения операторов распределительной системы из-за их важной роли в обеспечении общей безопасности системы. Технические специалисты в этой группе назначаются из ассоциаций DSO CEDEC, EDSO for Smart Grids, Eurelectric и GEODE.

Группы технических экспертов DSO отражают важность привлечения операторов распределительной системы из-за их важной роли в обеспечении общей безопасности системы. Технические специалисты в этой группе назначаются из ассоциаций DSO CEDEC, EDSO for Smart Grids, Eurelectric и GEODE.

Все материалы, включая протоколы и презентации собраний, будут опубликованы.

Обращение к заинтересованным сторонам

«Призыв к участию заинтересованных сторон», проходившее с апреля по май 2012 г., позволило провести открытое обсуждение некоторых новаторских доменов DCC, которые помогли в разработке этого кода. Кроме того, это помогло в написании сопроводительной документации, в которой объясняется, как DCC вписывается в контекст быстро меняющейся энергосистемы, где необходимы новые меры спроса.ENTSO-E использовала вклад 18 организаций, которые отреагировали на это, на протяжении всего процесса разработки DCC. Оценка предоставленной обратной связи приведена в пояснительной записке DCC, которая прилагается к коду сети.

Заседания технических экспертов DSO

Семинары с общественностью заинтересованных сторон

Связанные документы и ссылки

Справочная информация о процессе разработки DCC

5 января 2012 года Европейская комиссия (ЕК) предоставила ENTSO-E мандат на разработку в рамках двенадцатимесячный период действия Сетевого кодекса по промышленной нагрузке и подключениям DSO в соответствии с рамочными руководящими принципами по подключению к электросетям Агентства по сотрудничеству органов регулирования энергетики (ACER).Процесс разработки DCC, начиная с этапа предварительного определения объема работ и заканчивая постоянным совершенствованием черновой версии кодекса, руководствовался обширными отзывами заинтересованных организаций по всей Европе, включая сектор электроэнергетики, интеллектуальные сети и организации потребителей.

Состоялись два основных этапа консультаций. Во-первых, призыв к обратной связи с заинтересованными сторонами в апреле 2012 года был направлен на получение мнений об основных проблемах, с которыми необходимо справиться в NC DCC, и отзывов о первоначальных тематических исследованиях затрат и выгод. Во-вторых, официальные консультации по проекту версии DCC были открыты с 27 июня по 13 сентября 2012 года и собрали около 1500 индивидуальных комментариев и предложений по улучшению кода.

Во-вторых, официальные консультации по проекту версии DCC были открыты с 27 июня по 13 сентября 2012 года и собрали около 1500 индивидуальных комментариев и предложений по улучшению кода.

На протяжении всего процесса ENTSO-E постоянно взаимодействовал со специальной группой технических экспертов DSO по всем вопросам, влияющим на операторов распределительных систем (DSO) при внедрении DCC, и с группой пользователей DCC, которая в основном сосредоточивалась на положениях DCC по DSR. Все соответствующие документы, касающиеся согласованного результата этих взаимодействий, доступны здесь.

Обзор ключевых принципов DCC и мотивация последних изменений в коде были представлены на публичной информационной сессии 12 декабря 2012 года. Материалы, представленные на этой сессии, теперь также доступны. На основе отзывов, полученных в ходе этой сессии от различных организаций, ENTSO-E внес поправки в несколько пунктов DCC, чтобы прояснить процесс обеспечения соблюдения требований для DSR, предоставляемых малыми потребителями.

На данном этапе у ACER есть трехмесячный период для оценки соответствия положений DCC основным руководящим принципам подключения к электросетям.На основании положительной рекомендации ACER, ЕС инициирует процесс комитологии для принятия DCC в качестве обязательного европейского регламента.

Кодекс поведения сети USV

Наши обязательства

В интересах создания открытой и доброжелательной среды для всех членов нашего сообщества мы стремимся поддерживать безопасные, надежные пространства для всех членов USV Network, выпускников и других членов нашего сообщества.

У нас есть строгая политика против преследований, независимо от расы, цвета кожи, религии (включая религиозную одежду и религиозную практику ухода), национального происхождения, пола, пола, гендерной идентичности и / или самовыражения, генетической предрасположенности или статуса носителя, происхождения, возраста. , физическая или психическая инвалидность, состояние здоровья (включая беременность, роды, грудное вскармливание и связанные с ними заболевания), семейное, родительское, зарегистрированное семейное партнерство, военный или ветеранский статус, сексуальная ориентация, статус гражданства, статус жертвы домашнего насилия или любое другое основание запрещено действующим законодательством.

Наши принципы

Наши Руководящие принципы Сети подтверждают нашу приверженность созданию безопасных пространств для всех членов Сети. Взаимодействуя с другими членами нашего сообщества лично или удаленно, ожидается, что каждый участник будет демонстрировать поведение, которое способствует созданию благоприятной среды.

Примеры поведения, способствующего созданию благоприятной среды, включают:

- Доброжелательное руководство и непредвзятый подход

- Использование приветливого и инклюзивного языка

- Проявление уважения к людям с разным происхождением и опытом

- Соблюдение осторожности при передаче конфиденциальной информации

- Проявление сочувствия к другим членам нашего сообщества

Примеры недопустимого поведения участников:

- Использование сексуализированной лексики или образов и нежелательное сексуальное внимание или заигрывания

- Троллинг, оскорбительные / уничижительные комментарии и личные или политические нападения

- Публичное или частное преследование

- Публикация частной информации других лиц, такой как физический или электронный адрес , без явного разрешения

- Другое поведение, которое можно обоснованно считать неуместным в профессиональной среде

Участники и гости мероприятия

Все участники мероприятий USV Network должны зарегистрироваться заранее. Любые гости или +1 участники мероприятий сети USV должны быть одобрены Сетевой командой. Ожидается, что все гости зарегистрируются заранее, а гости (а также их спонсоры) должны соблюдать тот же Кодекс поведения. Несоблюдение может привести к исключению из Сетевого мероприятия или временному или постоянному запрету на посещение в будущем.

Любые гости или +1 участники мероприятий сети USV должны быть одобрены Сетевой командой. Ожидается, что все гости зарегистрируются заранее, а гости (а также их спонсоры) должны соблюдать тот же Кодекс поведения. Несоблюдение может привести к исключению из Сетевого мероприятия или временному или постоянному запрету на посещение в будущем.

Сообщение о дискриминации и домогательствах

Любой член нашего сообщества, который считает, что он или она был свидетелем, подвергался или узнал о любой форме дискриминации, преследования или преследования, должен немедленно уведомить главного администратора сети USV, Бетани Кристал, по адресу [электронная почта защищена].

Если вы хотите отправить сообщение анонимно, вы можете позвонить по номеру XXX-XXX-XXXX или отправить текстовое сообщение XXX-XXX-XXXX.